청각장애인의 그룹 대화 경험 향상을 위한 AR 말풍선 연구

초록

연구배경 본 연구는 청각장애인이 그룹 대화 중 비언어적 감정 정보를 효과적으로 전달받을 수 있도록 AR 말풍선을 활용한 대화 경험 개선 방안을 모색한다. 기존 연구는 건청인을 대상으로 한 사례가 많았으며, 청각장애인을 대상으로 한 연구는 제한적이었다. 특히 시각적 정보에 크게 의존하는 청각장애인에게 AR 말풍선은 대화 맥락 이해와 감정 전달을 효과적으로 지원할 가능성이 높다. 이에 본 연구는 AR 말풍선이 청각장애인의 그룹 대화 경험에 미치는 영향을 분석하고 적합한 감정 전달 방식을 제안하고자 한다.

연구방법 본 연구에서는 네 가지 AR 말풍선 타입(형태, 기본, 색상, 타이포그래피)을 설계하고, 청각장애인 12명을 모집하여 그룹 대화 시나리오를 기반으로 실험을 진행하였다. 각 실험 후 감정 전달 용이성, 대화 내용 이해도, 편리성 등을 평가하는 설문 조사와 인터뷰를 통해 데이터를 수집하였다. 양적 데이터는 Friedman 비모수 통계로, 질적 데이터는 주제별 코딩 접근법으로 분석하였다.

연구결과 실험 결과, 형태 타입의 AR 말풍선이 감정 전달 용이성과 대화 내용 이해도에서 가장 높은 평가를 받았다. 색상과 타이포그래피 타입은 시각적 복잡성으로 인해 이해도가 다소 떨어졌으나, 타이포그래피를 활용한 어조 표현은 동시 발화 상황에서 긍정적으로 평가되었다. 또한, 대화 상황과 사용자의 성향에 따라 AR 말풍선의 적합성이 달라질 수 있으며, 시각적 과부하를 줄이기 위한 단순화된 설계가 필요하다는 점이 확인되었다.

결론 본 연구는 청각장애인을 위한 AR 말풍선 설계 원칙으로 감정 전달 용이성, 시각적 단순화, 사용자 맞춤형 인터페이스 제공, 발화자 구분의 명확성을 제안한다. 이러한 설계는 청각장애인의 대화 경험을 향상시키고 사회적 통합에 기여할 수 있을 것이다.

Abstract

Background This study explores the use of augmented reality (AR) speech bubbles to improve group conversation experiences for individuals with hearing impairments by effectively conveying non-verbal emotional cues. While prior research has primarily focused on hearing individuals, studies addressing the needs of the hearing-impaired population remain limited. Given their reliance on visual information, AR speech bubbles hold potential for enhancing contextual understanding and emotional communication. Accordingly, this study investigates the impact of AR speech bubbles on group conversation experiences among hearing-impaired individuals and proposes effective design strategies for emotional expression.

Methods Four types of AR speech bubbles (form, basic, color, and typography) were designed for the experiment. Twelve participants with hearing impairments participated in simulated group conversation scenarios. After each session, participants assessed emotional conveyance, conversation comprehension, convenience, and service adoption intention using a 7-point Likert scale questionnaire. Semi-structured interviews were conducted to gather additional qualitative feedback. Quantitative data were analyzed using Friedman’s non-parametric statistical test, and qualitative data were thematically coded.

Results The form-type AR speech bubbles received the highest ratings for emotional conveyance and conversation comprehension. Conversely, the color and typography types were rated lower due to visual complexity. However, typography-based speech bubbles were positively received in situations involving overlapping speech, as they helped distinguish tone and pitch. Additionally, the effectiveness of AR speech bubbles varied depending on conversational context and individual user preferences. Simplified designs were recommended to minimize visual overload.

Conclusions This study suggests design principles for AR speech bubbles tailored to hearing-impaired users: ease of emotional conveyance, visual simplicity, personalization, and clear speaker differentiation. These principles aim to enhance conversational experiences and to support greater social inclusion for individuals with hearing impairments.

Keywords:

AR Speech Bubbles, Hearing Impairment, Group Conversation, Eemotion Conveyance, Non-verbal Information, Augmented Reality키워드:

AR 말풍선, 청각장애인, 그룹 대화, 감정 전달, 비언어적 정보, 증강 현실1. 서론

1. 1. 연구배경

소셜 시그널 처리(Social Signal Processing)는 인간의 비언어적 행동을 분석하여 사회적 상호작용을 자동으로 이해하는 것을 목표로 하는 연구 분야이다(Vinciarelli, Salamin, & Pantic, 2009). 비언어적 행동은 동의, 비동의, 공감, 적대감 등 다양한 태도를 포함하며, 음성, 표정, 신체 자세와 같은 비언어적 신호를 통해 나타난다. 이를 통해 사용자의 감정 상태를 분석하거나 대화형 에이전트와 가상현실 상호작용 개선 등의 응용이 이루어지고 있다(Torres et al., 2024).

의사소통에서 언어는 중요한 요소로 간주되지만, 비언어적 행동을 포함하지 않고는 완전한 의사소통이 이루어지기 어렵다(Matsumoto & Hwang, 2012). 비언어적 정보는 전체 커뮤니케이션의 약 70~90%를 차지한다고 평가될 정도로(Cho, 2007), 효과적인 의사소통에서 필수적인 요소이다. 하지만 이러한 비언어적 신호의 중요성에도 불구하고, 청각장애인을 대상으로 한 연구는 여전히 부족한 상황이다. 청각장애인은 건청인에 비해 음성에서 전달되는 비언어적 정보를 인지하기 어려우며, 입모양과 같은 시각 정보에 의존하지만 그룹 대화 상황에서는 이러한 한계가 더욱 두드러진다(Ha, 2020). WHO는 2050년까지 약 25억 명이 청력 상실 위험에 처할 것으로 예상하며, 이는 청각장애인의 사회적 상호작용 개선 연구의 필요성을 강조한다.

청각장애인을 위한 기존 연구들은 음성 자막 변환 기술 및 AR 글라스 기기를 통해 대화 이해도를 높이는 방안을 제시하였다. Sony와 Regal Entertainment가 개발한 AR 글라스는 소리의 공간적 위치를 인식하도록 돕고(Ma, Jain, & Anderson, 2014), 인공지능 기술을 활용한 새로운 AR 글라스는 소리를 시각적 정보로 변환해 청각장애인의 일상적 의사소통을 지원한다(Peng et al., 2018). 그러나 기존 기술은 단순히 대화 내용을 텍스트로 변환하는 데 초점이 맞춰져 있어 감정과 같은 비언어적 정보를 충분히 제공하지 못한다는 한계가 있다.

1. 2. 연구 목적

본 연구는 이러한 한계를 극복하기 위해 청각장애인이 놓칠 수 있는 비언어적 감정 뉘앙스를 AR 기반으로 시각화하는 방안을 제안한다. 만화적 기법을 활용한 “AR 말풍선”을 설계하여 그룹 대화 상황에 적용함으로써, 청각장애인의 대화 경험을 향상시키고자 한다. 만화적 기법은 직관적이며 글로벌 공통 언어로 활용 가능하여 청각장애인뿐만 아니라 다양한 사용자에게 유용하다.

본 연구는 세 가지 단계를 통해 청각장애인의 그룹 대화 경험을 심층적으로 이해하고 이를 개선하고자 한다. 첫째, 반구조적 인터뷰를 통해 청각장애인이 그룹 대화 시 겪는 어려움과 선호하는 의사소통 방식을 조사하였다. 둘째, 형태, 색상, 타이포그래피를 중심으로 감정을 시각화한 AR 말풍선의 초기 디자인을 제작하고 사용자 피드백을 바탕으로 이를 개선하였다. 마지막으로 개선된 AR 말풍선을 실제 그룹 대화에 적용하여 감정 전달, 대화 내용 이해도, 편안함, 사용 의지 등 다양한 요소와의 상관관계를 분석하였다.

본 연구는 비언어적 정보를 효과적으로 시각화하는 새로운 커뮤니케이션 방식을 제안함으로써, 청각장애인의 그룹 대화 경험을 개선하고 사회적 소외를 완화하는 데 기여할 것으로 기대된다.

2. 이론적 고찰

2. 1. 청각장애인의 대화 경험을 향상시키기 위한 기술적 시도

청각장애인은 구두 의사소통에서 발생하는 어려움을 극복하기 위해 수화, 필담, 입술 읽기 등 다양한 대체 방식을 사용해 왔다(Demorest et al., 1986; Gugenheimer et al., 2017). 그러나 이러한 방법들은 그룹 대화나 복잡한 사회적 상호작용 상황에서는 효과가 제한적이다. 이에 따라 다양한 기술적 접근이 개발되고 있으며, 크게 음성 자막 변환 기술과 비언어적 정보를 보완하는 방식으로 나뉜다.

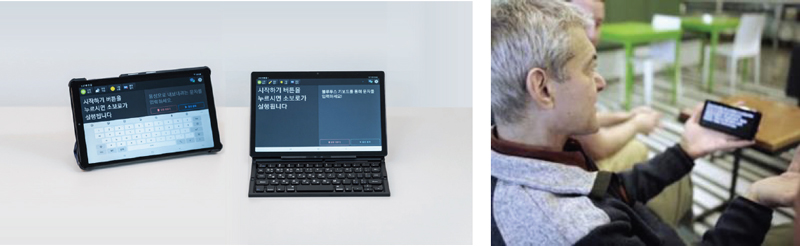

최근 등장한 음성 자막 변환 서비스는 청각장애인의 대화 이해를 돕는 주요 도구로 자리 잡았다. 구글의 Live Transcribe 앱과 소보로(SOVORO)는 대표적인 사례로, 실시간으로 음성을 텍스트로 변환하여 주변 대화를 쉽게 이해하도록 지원한다. 소보로는 2023년 기준 누적 이용 시간 8만 시간, 800개 고객사를 보유하고 있으며, Live Transcribe는 10억 건 이상의 다운로드를 기록하며 널리 사용되고 있다(Kim, 2023). <Figure 1>은 이러한 음성 자막 변환 서비스의 사용자 인터페이스를 나타낸다. 이러한 기술은 청각장애인의 발화 이해를 획기적으로 향상시켰으나, 감정과 같은 비언어적 정보를 전달하지 못하는 한계가 있다.

2. 2. 사람 간의 커뮤니케이션에서 감정과 색상의 역할

사람 간의 커뮤니케이션에서 감정은 중요한 역할을 하며, 특히 청각장애인은 음성에서 전달되는 비언어적 요소를 인지하기 어렵기 때문에 대화 상대의 감정을 잘못 이해하거나 놓칠 가능성이 크다(하주현, 2020). Ekman(1984)은 행복, 놀라움, 슬픔, 분노, 두려움, 혐오감의 여섯 가지를 인간의 보편적 감정으로 정의하였다. 이는 다양한 문화와 사회에서 공통적으로 나타나는 감정으로, 인공지능과 감정 인식 기술의 발전에 중요한 토대가 되고 있다.

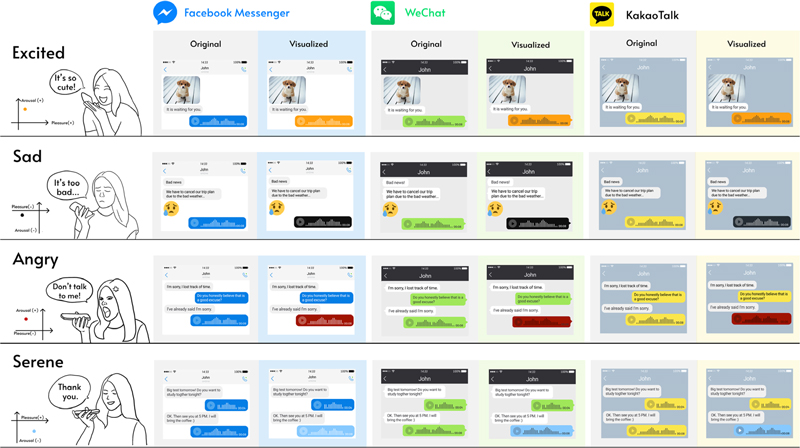

감정 전달에서 색상의 역할은 심리학 및 시각 디자인 분야에서 오랫동안 연구되어 왔다. Fugate(2019)는 색조, 채도, 밝기가 특정 감정을 강화하는 데 중요한 역할을 한다고 밝혔다. 예를 들어, 행복은 밝은 노란색, 분노는 강렬한 빨간색, 슬픔은 어두운 회색으로 표현된다. <Figure 2>는 Facebook Messenger, WeChat, KakaoTalk의 서비스에서 음성 입력에 따른 감정과 말풍선 색상 매핑 사례를 보여준다.

본 연구는 이러한 감정 분류와 색상 매핑 연구를 바탕으로, 청각장애인이 그룹 대화에서 비언어적 감정을 시각적으로 이해할 수 있는 AR 말풍선을 설계하고자 한다.

2. 3. 청각장애인을 위한 증강현실 기술의 가능성

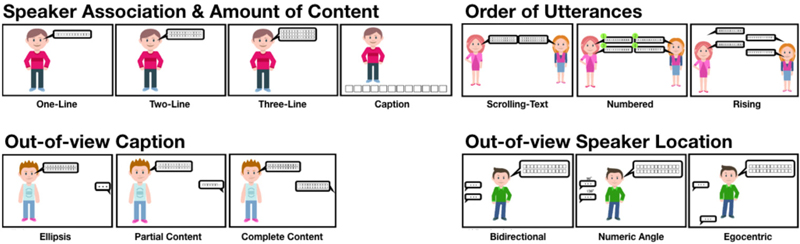

증강현실(AR) 기술은 청각장애인의 커뮤니케이션 환경을 혁신할 수 있는 잠재력을 지니고 있다. AR 글라스를 활용한 연구는 청각장애인의 그룹 대화 경험을 개선하기 위해 다양한 시도를 진행해왔다. Peng et al.(2018)은 그룹 대화에서 발화자와 발화를 연결하거나, 시야 밖 화자의 발화를 시각화하는 캡션 디자인을 연구하였다(Figure 3).

또한 씨사운드와 같은 제품은 실시간 자막 제공 외에도 감정과 연동된 색상 및 폰트를 통해 비언어적 정보를 강화한다1). 감정에 따라 글자 색상과 폰트를 자동 조정하여 대화 내용의 강조와 감정 전달을 동시에 실현한다. 이러한 기술적 시도는 청각장애인의 대화 참여를 촉진하며, 그룹 대화 상황에서 비언어적 감정 정보를 보완하는 데 효과적이다.

본 연구는 이러한 AR 기술을 활용하여 청각장애인이 그룹 대화에서 상대의 감정을 시각적으로 이해하고, 비언어적 정보를 효과적으로 제공할 수 있는 AR 말풍선을 설계하고자 한다. 이를 통해 기존 기술의 한계를 보완하고, 대화 경험을 혁신하는 방안을 제시할 것이다.

3. 청각장애인의 그룹 대화 경험과 보조기기에 대한 기대

3. 1. 사전 인터뷰 목적 및 방법

본 연구는 청각장애인이 그룹 대화에서 겪는 어려움을 이해하고, 대화 보조기기의 사용 경험 및 기대 사항을 조사하기 위해 반구조적 인터뷰를 실시하였다. 이를 통해, 2.1.에서 제시한 음성 자막 변환 서비스 SOVORO, Live Transcribe 등의 장단점과 개선점을 파악하고, 대화 참여 방식과 감정 전달의 어려움을 분석하였다.

청각장애인 13명과 건청인 3명을 대상으로 하였으며, 청각장애인의 경우 농인 7명, 난청인 6명으로 구성되었다. 참가자들의 청력 손실 정도는 경미한 경우부터 심각한 경우까지 다양했으며, 대다수는 보청기를 사용하였다. 연령대는 20대 9명, 30~40대 7명으로, 직장인과 학생이 포함되었다.

피험자들에게 일대일 대화와 그룹 대화의 차이점, 공적 및 사적 대화에서의 대화 방식, 음성 자막 변환 서비스의 사용 경험 및 개선 요구사항에 대해 질문하였다. 모든 인터뷰는 녹음 후 전사하여 주제별 코딩 분석(Gibbs, 2012)을 통해 정리하였다.

3. 2. 인터뷰 결과 분석

청각장애인은 일대일 대화에서 한 사람의 얼굴과 입 모양에 집중하여 대화의 내용과 감정을 파악하기 수월하다고 응답하였다. 반면, 그룹 대화에서는 대화의 흐름을 놓치거나 감정을 잘못 이해하는 경우가 많았다. 특히 그룹 대화 시에는 수화, 입술 읽기, 음성 자막 변환 서비스, 필담 등 다양한 방식을 복합적으로 사용하는 경우가 많았다(Table 1).

피험자들은 SOVORO와 Live Transcribe 등 음성 자막 변환 서비스를 일대일 및 그룹 대화에서 보조 도구로 사용하고 있었다. 서비스는 강의나 외국어 대화 시 유용하다는 의견이 많았지만, 화면에 집중해야 하는 특성으로 인해 대화 참여도가 떨어지는 단점이 지적되었다(Table 2).

피험자들은 공적 대화에서는 정확한 정보 전달과 업무 처리가, 사적 대화에서는 감정 교류와 유대감 형성이 중요하다고 응답하였다. 공적·사적 대화 모두에서 수어를 사용할 경우 얼굴 표정을 통한 감정 전달이 핵심적인 역할을 하였다(Table 3).

인터뷰 결과, 청각장애인은 그룹 대화에서 비언어적 감정 전달의 어려움을 겪고 있으며, 음성 자막 서비스는 정확한 정보 전달에는 유용하지만 감정 표현과 대화 참여도를 보완하기에는 부족한 것으로 나타났다. 본 연구는 이러한 한계를 해결하기 위해 AR 기술을 활용한 감정 시각화 도구 개발의 필요성을 확인하였다.

4. 청각장애인이 그룹 대화 시 겪는 어려움 및 AR 말풍선에 대한 사용자 요구사항 이해

4. 1. AR 말풍선 공동 설계 목적

본 실험은 청각장애인이 그룹 대화 중 놓치기 쉬운 비언어적 감정 정보를 AR 말풍선으로 시각화하고, 말풍선 디자인에 대한 요구사항을 도출하는 것을 목표로 하였다. 피험자와의 협업을 통해 1차로 제작한 AR 말풍선을 평가하고, 피드백을 바탕으로 최적화된 디자인을 완성하였다. 또한 감정 전달 용이성, 필요성, 장단점에 대한 의견을 청취하여 실제 그룹 대화 상황에 적용할 최종 디자인을 설계하였다.

4. 2. AR 말풍선 공동 설계 방법

피험자는 청각장애인 13명과 건청인 3명, 그리고 시각 디자인 전문가 2명으로 구성되었다. 청각장애인의 청력 손실 정도는 경미한 경우부터 심각한 경우까지 다양했으며, 대다수가 보청기를 사용하였다. 피험자들은 그룹 대화 경험과 AR 말풍선에 대한 피드백을 제공하였고, 전문가들은 최종 디자인 점검 및 세부 사항 조정에 참여하였다.

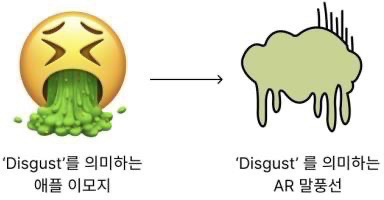

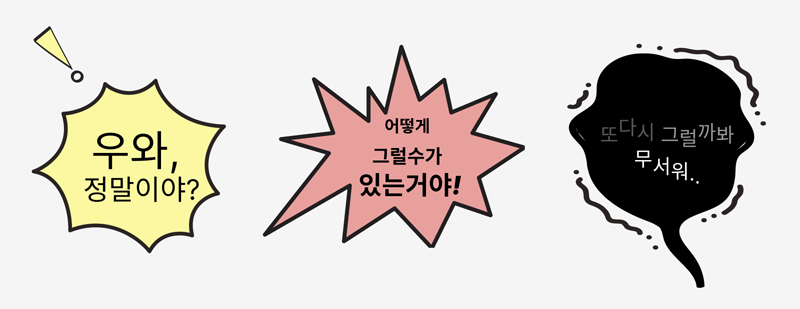

Ekman(1984)의 기본 6가지 감정(행복, 놀라움, 슬픔, 분노, 두려움, 혐오감)에 '차분함'을 추가하여 총 7가지 감정에 대한 말풍선을 설계하였다. 만화적 기법과 다양한 레퍼런스를 참고하여 말풍선의 형태, 색상, 타이포그래피를 세 가지 주요 요소로 구분하고 디자인하였다.

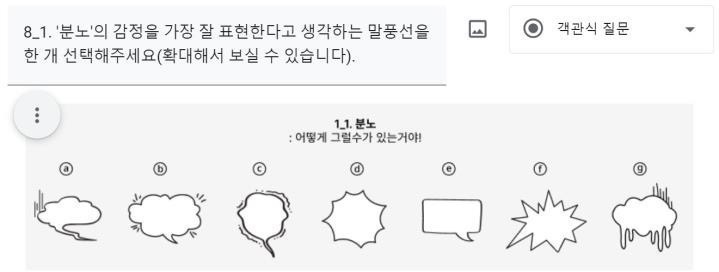

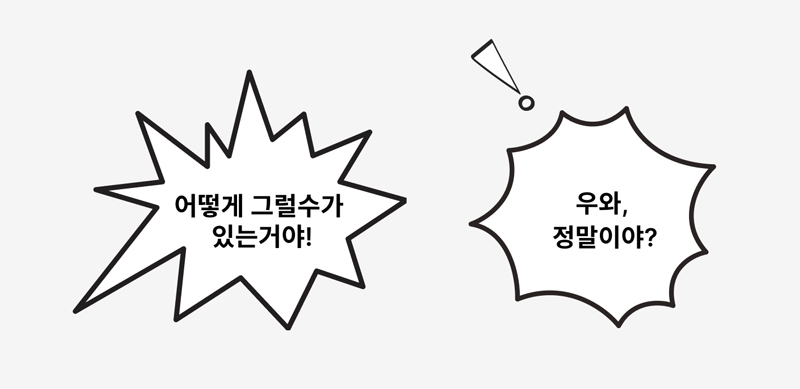

형태: 분노는 폭발하는 직선형, 행복은 몽글몽글한 구름형, 슬픔은 세로 직선 요소를 강조한 하강형으로 표현하였다. 놀라움은 곡선을 강조한 물방울형으로, 두려움은 점선으로 떨림을 묘사하였다. 혐오는 녹는 듯한 형태를 추가하였다(Figure 4).

색상: Fugate(2019)의 감정-색상 연관성 연구를 참고하여 색조, 채도, 밝기를 활용해 감정을 구별할 수 있도록 설계하였다(Figure 5).

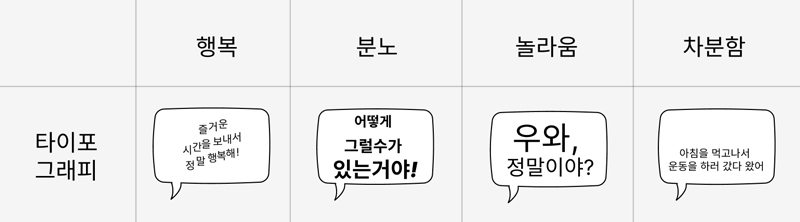

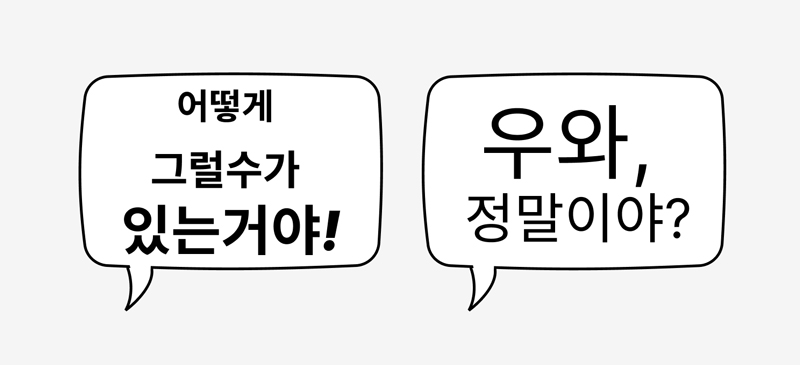

타이포그래피:텍스트의 크기, 기울기, 위치 변화를 통해 감정 전달 효과를 강화하였다. 예를 들어, 행복은 상승감을, 슬픔은 하강감을, 분노와 놀라움은 크기 변화를 적용해 감정의 강약을 표현하였다(Figure 6).

4. 3. AR 말풍선 공동 설계 워크숍

이렇게 설계한 3가지 타입의 말풍선을 바탕으로 피험자들에게 자유롭게 의견 및 형태를 제안하도록 요청하였다. 이어서 피험자들은 <Figure 7>과 같은 감정 관련 대사를 보고 해당 감정에 가장 어울리는 말풍선을 선택하도록 요구 받았다.

말풍선의 감정별 대사는 다음과 같다(Table 4).

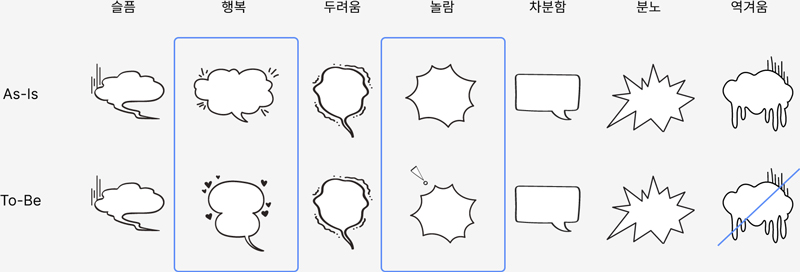

형태 개선16명 중 4명의 피험자들이 분노와 놀라움 말풍선이 모호하게 느껴진다는 의견을 주었고, P5가 제안한 ‘만화책의 등장 인물이 놀랐을 때 말풍선이 표시되는 것처럼 구분되면 좋을 것 같다’는 의견을 반영하여 놀라움에 느낌표를 추가하였다(Figure 8). 추가로 행복 말풍선은 하트 그래픽을 추가하여 감정을 보다 명확히 표현하였다. 슬픔, 두려움, 혐오 간의 혼동을 줄이기 위해 혐오 말풍선을 제외하였다.

색상 및 타이포그래피 조정감정과 색상 관련해서는 차분함의 감정이 모호하다는 의견이 있었다. 차분함은 하늘색 보다는 흰색으로 표현하는 것이 더 나을 것 같다고 했다(P1, P5). 그리고 칼라를 적용했을 경우 가독성이 떨어질 수 있을 것 같다는 의견(P6, P9, P12)을 반영해 투명도를 적용해서 명도와 채도를 낮추어 텍스트 가독성을 보완했다. 타이포그래피에 있어서도 피험자들은 가독성을 최우선으로 고려할 것을 요청하였으며(P1, P2, P3, P4, P8, P11, P12), 이를 반영해 산세리프체를 적용하고, 그래픽 효과를 최소화하였다. 문장의 기울기와 크기 변화는 감정을 표현하되 텍스트의 읽기 편의성을 해치지 않는 선에서 적용되었다. 마지막으로 ‘혐오’와 ‘두려움’ 텍스트 모두 전체적으로 하강하면서 페이드아웃 처리되듯 점차 투명해지도록 구성한 점이 유사해 뚜렷한 차이가 나지 않아 ‘혐오’ 타이포그래피를 본 실험에서는 제외하기로 했다.

워크숍을 통해 보완된 AR 말풍선은 감정과 시각적 표현 간의 연관성을 강화하고, 피험자들의 인식 차이를 최소화하는 방향으로 설계되었다. 최종적으로 개선된 말풍선은 형태, 색상, 타이포그래피를 통합하여 감정 전달의 명확성을 높였다(Figure 9).

최종 결과는 감정 표현의 시각적 요소들을 구체화함으로써, 청각장애인이 그룹 대화 중 비언어적 감정을 보다 명확히 이해할 수 있는 도구를 제안하였다. 특히 AR 말풍선의 형태와 색상, 타이포그래피 개선은 감정 전달 효과를 극대화하고, 사용자 요구사항을 충족시켰다. 본 설계는 향후 그룹 대화 환경에서 감정 전달의 효과를 평가하는 데 유용하게 활용될 것으로 기대된다.

5. AR 말풍선 타입별 그룹 대화 경험의 차이와 인식 파악

5. 1. 실험 목적

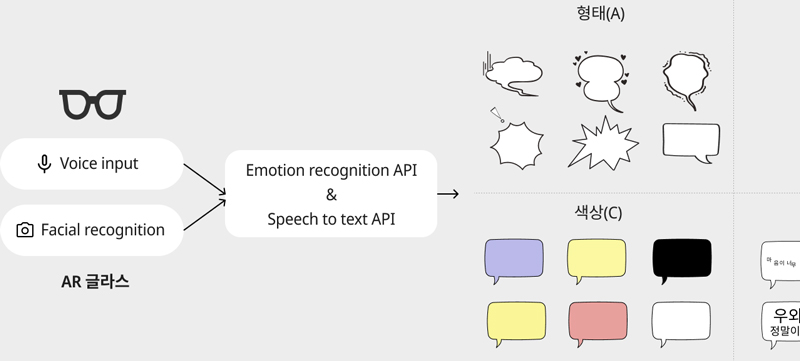

본 실험은 청각장애인이 1) 형태, 2) 기본, 3) 색상, 4) 타이포그래피 네 가지 타입의 AR 말풍선을 사용하여 그룹 대화에 참여할 때, 각 타입이 대화 경험에 미치는 영향을 분석하는 것을 목적으로 한다. 감정 전달 용이성, 선호도, 편리성, 대화 내용 이해도, 서비스 사용 의지 측면에서 차이를 평가하였다.

5. 2. 실험 방법

연구를 위해 12명의 청각장애인을 모집하였다. 이들 중 10명은 인공와우 또는 보청기를 착용하고 있었으며, 청력 보조 기구를 착용한 상태에서 들리는 정도는 다양했다. 피험자 중에는 시각 또는 산업 디자인을 전공한 3명이 포함되었고, 한 명은 AR 기반 청각 보조 장비 사용 경험이 있었다. 실험 종료 후 모든 피험자에게 소정의 보상을 제공하였다.

조작 변인은 네 가지 타입의 AR 말풍선(형태, 기본, 색상, 타이포그래피)이다(Figure 10). 실험은 두 명의 연기자가 다양한 감정을 표현하며 대화하는 영상을 기반으로 하였고, 피험자는 AR 글라스를 착용한 상태에서 이를 관찰하며 대화에 참여하는 환경을 시뮬레이션하였다. 대화 시나리오는 3분간의 그룹 대화를 재현하여 슬픔, 행복, 두려움, 놀람, 분노, 차분함 등 6가지 감정을 담도록 구성되었다. 예시 대사는 다음과 같다:

A: "올 여름에 뉴질랜드에 갈 생각에 너무 기뻐!" (행복)

B: "그치만 그동안 당신을 볼 수 없으니 슬퍼.." (슬픔)

A: "일주일만 갔다 올 테니 조금만 기다려~" (기본)

실제 실험은 40인치 TV 스크린 앞에서 Wizard of Oz 방식을 사용하여 진행하였다. 시스템은 AR 글라스를 통해 음성 인식, 얼굴 인식, 감정 인식 데이터를 기반으로 네 가지 말풍선 타입이 순서대로 적용되도록 구성되었다. 각 대화 세션이 끝날 때 피험자는 7점 리커트 척도를 사용하여 대화 만족도(감정 전달 용이성, 편리성, 대화 내용 이해도, 서비스 사용 의지)를 평가하였다. 실험 종료 후에는 반구조적 인터뷰를 통해 피험자의 추가 의견을 수집하였다.

5. 3. 실험 결과

본 연구의 표본은 12명으로 정규 분포를 가정 할 수 없다. 따라서 Friedman의 비모수통계를 활용하여 조작변인 형태(A), 기본(B), 색상(C), 타이포그래피(D) AR 말풍선의 (1) 감정 전달 용이성, (2) 대화 내용 이해도, (3) 편리성, (4) 해당 서비스 사용 의지 차이를 검증하였다(Table 5). 유의한 차이가 나타난 항목에 대해서는 Wilcoxon Signed-Rank Test로 쌍별 비교를 수행하였고, 다중 비교에 따른 오류를 방지하기 위해 Bonferroni 보정을 적용하여 사후분석을 진행하였다.

형태(A)가 감정 전달 용이성 측면에서 가장 높은 점수를 받았으나, 통계적으로 유의미한 차이는 없었다(p=0.055). 특히 분노와 놀라움을 표현한 말풍선이 익숙하고 직관적이라는 피드백이 많았다(Figure 11).

“형태(A) 말풍선이 무한도전 같은 예능프로에서 보던 자막이 생각나서 흥미롭고 몰입이 더 잘 됐어요. 기본(B) 말풍선보다 상대방 기분 파악이 더 잘 됐던 것 같아요.” -P6

흥미롭게도 타이포그래피(D)의 놀라움, 분노 말풍선이 말의 음낮이 차이에 따른 크기 변화가 말의 미묘한 음낮이 차이를 파악하는데 많은 도움이 된다고 답한 응답자들도 있었다(Figure 12).

“우리가 대화할 때 감정이 상해서 부정적인 감정이 들 때는 음이 낮아지잖아요, 그리고 강조를 하거나 긍정적일 땐 목소리가 커지잖아요. 예를 들어 ‘맞아!’하고 맞장구칠 때도 순간적으로 목소리가 커지죠. ‘맞아!’라는 증강 글자 크기가 커지면 ‘아, 이 친구는 이런 걸 좋아하는구나’ 이렇게 파악하기가 쉽달까요?” -P10

반면에 여러 사람이 대화하는 상황이라 자막 읽는데 집중해야해서 말풍선 형태를 볼 겨를이 없었다는 의견도 있었다.

“텍스트 읽는데 집중하느라 말풍선 형태가 바뀌는걸 잘 볼 수 없었어요. 그래서 어떤 차이가 있는지 잘 모르겠어요. 특히 지금처럼 여러 사람하고 대화할 때는 더 그래요.” - P4

형태(A)는 색상(C)과 타이포그래피(D)에 비해 대화 내용 이해도가 유의미하게 높았다(p=0.006). 피험자 P4는 형태(A)가 화자의 생각이나 의도를 이해하는데 더 도움이 된다고 답했다. 반면에 색상(C), 타이포그래피(D)처럼 색상과 글자 자체에 형태적 변화가 많은 자막은 대화 내용을 이해하는데 도움이 되지 않는다는 의견들도 있었다.

“일정한 예측성이 없는 색상(C), 타이포그래피(D)는 자막에 집중되지 않아 도움이 되지 않았어요. 특히 타이포그래피는 끝에 갈수록 투명해지는 글자를 읽기 어려웠어요.” - P12

AR 글라스로 대화 시 캡션을 증강할 때 이미 사람, 배경 등 시각적인 요소가 많은 상황에서 색상 변화는 혼란을 가중 시킨다는 의견들도 있었다(Figure 13).

“색깔 같은 경우는 환경에 구애를 많이 받을 것 같아요. 뒷배경 같은거요. 대화할 때 뒷배경이 흰색이었는데 말풍선도 흰색일 때는 잘 구분이 가지 않았어요. 그리고 사람, 배경, 말풍선이 복잡해서 약간 정신이 없는 것 같아요.” - P5

형태(A)와 기본(B)은 색상(C)보다 유의미하게 편리성이 높은 것으로 나타났다(p=0.007). 편리함 측면에서 형태(A)를 가장 선호한 참가자는 시야에서 벗어난 사람이 말을 할 경우에는 어조가 어떤지, 그 사람이 어떤 표정으로 대화하는지 알기 어려운데 형태(A)로 상대가 화가 났다는걸 알 수 있었던 점이 좋았다고 답했다. 또 여러명이 있을 때 맞은편에 정면으로 앉아있는 사람은 입술 읽기를 하면서 대화할 수 있어서 상대적으로 잘 알아들을 수 있지만 바로 옆에 앉아있는 사람은 입술 읽기가 안돼서 뭐라고 하는지 못알아 들을때가 많다고 했다(P7).

편리함 측면에서는 ‘가독성’을 중요하게 생각하는 피험자가 많았다(Figure 14). 편리함 측면에서 가독성을 고려한 많은 피험자들은 감정의 시각화가 반영되지 않은 기본(B)타입을 선호하는 경우도 많았다(P3, P6 P9, P12)

“편리성을 고려하자면, 역시나 기본(B)타입이 편리할 것 같습니다. 바로바로 지나가는 사람들의 대화는 속도가 빠르기에 집중도와 연관이 크기 때문입니다.” -P3

형태(A)는 서비스 사용 의지에서 가장 높은 평가를 받았으며, 타이포그래피(D)의 음의 높낮이를 반영한 말풍선은 특정 상황에서 긍정적으로 평가되었다.

“청각장애인마다 가청 할 수 있는 주파수 영역이 천차만별로 달라요. 높은 주파수가 잘 안들리는 경우가 있고 낮은 주파수가 오히려 잘 들리는 경우도 있어요. 이 놀라움과 분노처럼 음의 높낮이를 글자 크기로 시각화하면 청각장애인마다 개별적으로 구분하기 어려운 소리의 높낮이 차이를 알 수 있어 대화에 도움이 많이 될 것 같아요.” -P11

청각장애인끼리 대화할 때 해당 서비스를 사용한다면 내향형, 외향형인 성격에 따라서 사용 의지가 달라질 것 같다는 의견도 있었다. P6은 “행복한 감정이 하트로 표현되고 제 화난 감정이 말풍선으로 표현되는게 약간 부담스러울 것 같아요. 저는 평소에도 감정적으로 뭔갈 표현하는 스타일이 아니어서 그런 것 같아요.”라고 답하기도 하였다.

또한, 청각장애인끼리 사용할 때 ‘나’의 감정이 말풍선화 되어서 상대에게 보여지는 것은 다소 부담된다는 의견이 있었다. P1은 “상대방의 감정 말풍선을 보는건 대화에 도움이 될 것 같아 괜찮지만, 제 감정이 말풍선화 되는건 약간 부담스워요.”라고 말하며 감정이 잘못 전달되거나 ‘분노’와 같이 과하게 드러난 감정이 전달되기는 원하지 않았다. 이외에도 AR 말풍선의 형태, 색상, 타이포그래피를 혼합해서 <Figure 15>와 같이 사용하는 방향을 제안한 피험자도 있었다(P9).

6. 결론 및 논의

6. 1. 소결

본 연구에서는 청각장애인의 그룹 대화 경험 향상을 위해 네 가지 타입의 AR 말풍선을 적용한 실험을 진행하였다. 분석 결과, 형태(A) 타입의 말풍선이 감정 전달과 대화 내용 이해도 측면에서 가장 효과적인 것으로 나타났다. 반면, 색상(C)과 타이포그래피(D) 타입은 시각적 요소가 많아 복잡한 대화 상황에서는 오히려 정보 이해를 방해할 수 있는 한계가 있었다. 피험자들은 단순성과 가독성을 중요하게 평가했으며, 상황에 따라 적절히 조합된 형태의 AR 말풍선이 보다 효과적일 가능성을 시사하였다. 이러한 결과를 바탕으로, 본 연구는 감정 전달의 용이성과 대화 경험 개선을 위한 AR 말풍선 설계 방향성을 제안하고자 한다.

6. 2. 청각장애인의 그룹 대화 경험에 AR 말풍선이 미치는 영향

본 연구는 AR 말풍선이 청각장애인의 그룹 대화 경험을 어떻게 개선할 수 있는지에 대해 실험과 분석을 통해 다음과 같은 결론을 도출하였다. 첫째, 일대일 대화보다 여러명과 대화할 때 AR 말풍선이 대화 분위기를 파악하는데 도움이 된다. 여러명이 대화할 때는 청각장애인의 시야에 들어오지 않는 사람이 말을 하는 경우도 종종 생긴다(Figure 16).

Example of situations where hearing-impaired individuals must observe conversation partners from multiple angles during group conversations

대화 상대가 옆자리에 앉아있거나 갑자기 멀리서 다가올 경우에 상대가 시야에서 벗어나므로 입술 읽기와 얼굴 표정으로 맥락을 읽기 어려울 수 밖에 없다. 실험 피험자들은 여러 사람과 대화할 때 상대방의 입술 모양과 표정을 번갈아 보면서 일부 대화를 놓치곤 했는데, 말풍선에 감정을 적용함으로써 대화의 분위기와 맥락을 파악하기가 한결 수월해졌다고 답했다. 이때 AR 말풍선의 형태적 특성을 통해 상대방의 감정과 텍스트를 전달하는 방식이 대화 경험에 가장 많이 도움이 되는 것으로 나타났다.

둘째, AR 말풍선은 대화 상황과 사용자의 성향에 따라 다르게 설계되어야 한다. 공적 대화에서는 단순하고 차분한 디자인이 적합하며, 사적 대화에서는 감정을 보다 풍부하게 표현하는 디자인이 효과적이라는 의견이 있었다. 내향적인 사용자는 자신의 감정이 과도하게 표현되는 것을 부담스러워할 수 있으므로, 사용자의 성향에 맞춘 조정이 필요하다. 또한 색상과 타이포그래피 등의 시각적 요소는 복잡한 환경에서 혼란을 야기할 수 있으므로, 특정 감정이나 중요한 단어만 강조하거나 배경을 블러 처리하여 시각적 과부하를 줄이는 방법이 요구된다.

셋째, 어조의 높낮이를 시각화한 타이포그래피는 감정 전달에 효과적이었다. 텍스트 크기와 모션을 활용하여 발화자의 어조와 감정 뉘앙스를 표현하는 방식은 대화 이해도를 높이는 데 기여했다. 특히 동시 발화 상황에서 텍스트 크기로 발화자에 대한 시선을 유도하는 방식은 효과적인 접근법으로 나타났다. 이는 건청인이 대화 중 목소리가 큰 발화자에게 자연스럽게 시선이 가는 것과 유사하게, 청각장애인에게 텍스트 크기를 활용한 자연스러운 대화 경험을 제공할 수 있었다.

넷째, AR 환경에서 가독성을 높이기 위해 말풍선의 장식적 요소는 상황에 맞게 가감해야 한다. 실시간 전사는 빠르게 진행되며, 텍스트가 생성되고 소멸되는 과정에서 시각적 피로를 유발할 수 있다. 따라서 반투명 효과를 적용하거나 애니메이션을 최소화하는 방식을 통해 가독성을 개선할 필요가 있다. 예를 들어 여러 사람이 동시다발적으로 발화하는 상황에서는 텍스트 크기를 키워 감정을 표현하고, 일반 대화에서는 단순한 디자인을 유지해 시선을 집중시킬 수 있다.

마지막으로, AR 말풍선은 글로벌 환경에서 청각장애인의 의사소통을 개선하는 데 큰 잠재력을 가진다. 입술 읽기 방식은 외국어 대화에서 한계가 있으나, AR 말풍선은 발화자의 얼굴 옆에 자막을 띄워 자연스러운 대화 경험을 제공할 수 있다. 발화자를 구분하고 감정을 시각적으로 표현하는 기능은 특히 효과적이었다. 이러한 특성은 다양한 언어와 문화적 배경을 가진 사용자들에게도 유용하게 적용될 수 있을 것이다.

6. 3. 연구 한계 및 추후 연구 방향

본 연구는 30인치 TV 스크린을 사용하여 AR 말풍선 환경을 시뮬레이션하였으나, 실제 AR 글라스를 착용했을 때와는 경험적 차이가 있을 수 있다. 대화 상대의 비언어적 요소(어조, 표정 등)를 매번 동일하게 유지하기 어려운 점을 고려하여 영상을 사용해 변수를 통제하였다. 다만 이는 실제 대화 환경에서의 경험을 완전히 대체하지 못하므로, 향후 연구에서는 실제 AR 글라스를 활용한 실험이 필요할 것이다.

추후 연구에서는 자막 증강 방식을 통한 AR 말풍선이 감정 뉘앙스 전달 뿐만 아니라 대화 시 일어나는 다양한 어려움을 섬세하게 해결해 주는 통합적 방안을 제안할 수 있을 것이다. 예를 들어 청각장애인의 원활한 대화를 위해 많이 사용하는 방식인 ‘다시 묻기’를 AR 말풍선 시스템으로 대체 가능할 것이다. 인터뷰와 선행 연구에 따르면 청각장애인이 대화 시 정확히 알아듣지 못한 말을 상대에게 되묻거나 알아듣지 못한 상태로 넘어가는 경우가 많다고 답했다. 전자기기에 증강되는 AR 말풍선은 이를 빠르게 되돌려 볼 수 있는 시스템 제공이 가능하며, 이를 통해 청각장애인이 대화 도중 다시 묻고 싶은 상황에서도 분위기 때문에 말하지 못하고 넘어가는 상황적 어려움을 개선할 수 있을 것으로 기대한다. 다만 대화가 진행되는 중이므로 전체적인 대화 맥락을 놓치지 않을 수 있는 재빠르면서도 섬세한 UX에 대해 고민하는 것이 필요하다.

증강 현실을 통한 대화는 사용자 별로 원하는 방식으로 대화하는 미래 환경을 가능케 한다. AR로 대화 할 때 현실에 함께 있는 사람, AR 비디오 콜을 통해 대화하는 사람, 카메라 사용이 어려워 채팅으로만 대화하는 상대방 등 서로 다른 환경에 처한 여럿이 모여 그룹 대화를 할 때 AR 자막을 제공하는 방법에 대한 연구도 이루어질 필요가 있다. 이와같은 후속 연구들을 통해 청각장애인이 사회에서 보다 편안하게 대화하는 미래를 기대해본다.

Acknowledgments

This paper was written by reconstructing Moon Jeong Kim’s master’s thesis in 2024.

Notes

Copyright : This is an Open Access article distributed under the terms of the Creative Commons Attribution Non-Commercial License (http://creativecommons.org/licenses/by-nc/3.0/), which permits unrestricted educational and non-commercial use, provided the original work is properly cited.

References

-

Chen, Q., Yan, Y., & Suk, H. (2021). Bubble Coloring to Visualize the Speech Emotion. In Extended Abstracts of the 2021 CHI Conference on Human Factors in Computing Systems, 361, 1-6.

[https://doi.org/10.1145/3411763.3451698]

-

Cho, H. (2007). Special characteristics of non-verbal communication of Korean people in Korean Language Education. The Korean Society Of Bilingualism, 33, 269-296.

[https://doi.org/10.17296/korbil.2007..33.269]

-

Demorest, M. E., & Erdman, S. A. (1986). Scale Composition and Item Analysis of the Communication Profile for the Hearing Impaired. Journal of Speech and Hearing Research, 29(4), 515-535.

[https://doi.org/10.1044/jshr.2904.535]

- Ekman, P. (1984). Expression and the Nature of Emotion. In Scherer, K. & Ekman, P. (Eds.), Approaches to Emotion (pp. 319-343). Hillsdale, NJ: Lawrence Erlbaum.

-

Fugate J. M. B., & Franco, C. L. (2019). What Color Is Your Anger? Assessing Color-Emotion Pairings in English Speakers. Frontiers in Psychology, 10, 206.

[https://doi.org/10.3389/fpsyg.2019.00206]

- Gibbs, G. R. (2007). Thematic Coding and Categorizing, Analyzing Qualitative Data. London: SAGE Publications Ltd.

-

Gugenheimer, J., Plaumann, K., Schaub, F., San Vito, P. D. C., Duck, S., Rabus, M., & Rukzio, E. (2017). The Impact of Assistive Technology on Communication Quality Between Deaf and Hearing Individuals. In Proceedings of the 2017 ACM Conference on Computer Supported Cooperative Work and Social Computing, 669-682.

[https://doi.org/10.1145/2998181.2998203]

-

Ha, J. H. (2020). Recognizing Non-verbal Information of Hearing-Impaired People from Movement of Letters on Screen - Based on Auditory and Emotional Information of a Human Voice. Journal of Digital Contents Society, 21(2), 337-346.

[https://doi.org/10.9728/dcs.2020.21.2.337]

- Kim, J. (2023, Oct 30). "Decided to Start a Business After Reading a Webtoon, Stepped Up to Help the Hearing Impaired"… The Dream of a POSTECH Student, Hankyoung Geeks. https://www.hankyung.com/article/202310237590i..

-

Ma, M., Jain, L. C., & Anderson, P. (2014). Future Trends of Virtual, Augmented Reality, and Games for Health. In: Ma, M., Jain, L., Anderson, P. (eds) Virtual, Augmented Reality and Serious Games for Healthcare 1, Berlin: Springer.

[https://doi.org/10.1007/978-3-642-54816-1]

- Matsumoto, D., & Hwang, H. (2012). Nonverbal communication: the messages of emotion, action, space, and silence. London: The Routledge Handbook of Language and Intercultural Communication.

-

Peng, Y., Hsi, M., Taele, P., Lin, T., Lai, P. Hsu, L. Chen, T., Wu, T. Chen, Y., Tang, H., & Chen, M. Y. (2018). SpeechBubbles: Enhancing Captioning Experiences for Deaf and Hard-of-Hearing People in Group Conversations. In Proceedings of the 2018 CHI Conference on Human Factors in Computing Systems, 293, 1-10.

[https://doi.org/10.1145/3173574.3173867]

-

Torres, S. C., Gracia Laso, D. I., Minissi, M. E., Maddalon, L., Chicchi Giglioli, I. A., & Alcañiz, M. (2024). Social Signal Processing in Affective Virtual Reality: Human-Shaped Agents Increase Electrodermal Activity in an Elicited Negative Environment. Cyberpsychology, Behavior, and Social Networking, 27(4), 268-274.

[https://doi.org/10.1089/cyber.2023.0273]

-

Vinciarelli, A., Salamin, H., & Pantic, M. (2009). Social Signal Processing: Understanding social interactions through nonverbal behavior analysis. In 2009 IEEE Computer Society Conference on Computer Vision and Pattern Recognition Workshops, 42-49.

[https://doi.org/10.1109/CVPRW.2009.5204290]