Augmented Reality(AR) 정보전달 방식의 Head Up Display(HUD) 내 화살표 간격과 깜빡임 속도 차이가 운전자의 시지각 및 인지작용에 미치는 영향

초록

연구배경 자동차의 전장 시스템이 발전하면서 자율주행 연구가 진전되고 있으며, 이로 인해 내부 정보 전달 방식도 변화하고 있다. Head Up Display(HUD) 영역의 연구 발전으로 주행 중 시선 이탈을 줄이고 더 안전한 주행이 가능해지는 긍정적인 평가가 이루어지고 있다. 그러나 자율주행 3단계의 과도기적인 상황에서 Augmented Reality-Head Up Display(AR-HUD)가 시지각 및 인지 부하에 영향을 미칠 수 있다는 의견이 제기되고 있다. 이 연구는 AR-HUD의 정보 전달 방식이 자율주행 현 3단계의 과도기적 상황에서 운전자에게 미치는 영향을 화살표의 간격과 깜빡임 속도의 변화를 통해 조사해 보고자 한다.

연구방법 문제를 제기하고 이론적 고찰과 화살표 사례 분석을 통해 연구모형을 설계하고 연구문제 설정 후 실험을 진행했다. 실험은 30명을 대상으로 시뮬레이션 주행과 아이트래킹, 녹화, 설문조사 및 개별 심층 인터뷰로 진행되었으며 다양한 분석 방법을 통해 결과를 도출했다.

연구결과 R-HUD의 화살표 간격과 속도가 운전자의 주행완료 시간과 인지에 각각 영향을 미친다는 것을 확인하였다. 또한, 화살표의 간격과 속도는 운전자의 인지에 독립적인 영향을 미쳤다. 숙련도는 조절 변수로서 영향을 주지 않았다. 전반적으로 AR-HUD에 대한 사용성 평가는 긍정적이었으나, 화살표의 빠른 속도는 심리적 압박을 증가시킬 수 있음을 발견했다.

결론 AR-HUD의 화살표 간격과 깜빡임 속도는 운전자의 시지각, 인지 및 주행속도에 영향을 미치므로 이를 고려하여 화살표의 간격 및 속도를 조절하면 운전자의 인지적 부담을 줄이고 안전한 운전 행동을 유도할 수 있을 것이다.

Abstract

Background As automotive front-end systems evolve, autonomous driving research are being advanced, leading to changes in internal information delivery methods. The development in the head-up display (HUD) area is receiving positive evaluations for reducing drivers’ distractions and facilitating safer driving. However, during the transitional phase of Level 3 autonomous driving, concerns are being raised about the impact of augmented reality-head up display (AR-HUD) on drivers’ visual perception and cognitive load. This study aims to investigate the effect of an AR-HUD’s information delivery method on drivers in the current transitional phase of Level 3 autonomous driving by examining the changes in the spacing and flashing speed of arrows.

Methods The study raised a problem and, through theoretical consideration and analysis of arrow examples, designed a research model and set research questions, followed by conducting experiments. The experiments were carried out with 30 participants, involving simulated driving, eye-tracking, recording, surveys, and individual in-depth interviews, and the results were derived through various analytical methods.

Results The spacing and speed of arrows in AR-HUD had an impact on the drivers’ completion time and cognition while driving. Furthermore, the spacing and speed of the arrows independently influenced the drivers’ cognition. Proficiency, as a moderating variable, did not have an effect. Overall, the usability evaluation of AR-HUD was positive, but the fast speed of the arrows could increase psychological pressure.

Conclusions Considering that the spacing and blinking speed of arrows in AR-HUD affect drivers’ visual perception, cognition, and driving speed, adjusting the speed and spacing of the arrows could reduce cognitive load on drivers and promote safer driving behavior.

Keywords:

HMI, AR-HUD, Visual Perception, Cognitive Functioning, 시지각 인지, 인지 작용1. 연구의 배경 및 목적

IT(Information Technology) 산업의 발전으로 자동차 전장 시스템은 급속도로 발전하고 있다. 특히, 엣지 컴퓨팅(Edge computing)과 센서시스템(Sensor system)의 발전으로 인해 자동차 제조 기업들은 자율주행 택시 및 PBV(Purpose Built Vehicles)를 위한 기술 연구와 개발을 진행하고 있다(현대 모터스 그룹, 2021). SAE(Society of Automotive Engineers)의 가이드라인에 따르면 자율주행은 6단계로 나뉘며, 현재는 레벨 2~3단계로 운전자가 전방주시 의무에서 자유로워지기 위한 인터페이스 개발이 이루어지고 있다. 특히, 2023년 차량 전면에 투영하는 AR-HUD의 시장 성장세는 2029년까지 25.14% 성장할 것으로 예상되며, 2022년 28억 1천만 달러에서 2029년에는 3,150억 달러 이상 시장 규모에 이를 것으로 예상된다(Exactitude consultancy, 2023). 그러나 이러한 시장의 성장세와는 반대로(Giordano, 2012), 자율주행의 과도기적 상황에서의 AR의 적용이 운전자에게 주행 중 시지각 및 인지 작용에 어떤 영향을 미치는지에 관한 부정적인 우려도 제기되고 있다(Wang et. al., 2021). 현재 과도기적인 상황에 있는 AR-HUD는 운전자의 안전한 운행을 유도할 수 있도록 연구를 통해 부정적 우려를 개선할 필요가 있다.

본 연구는 AR-HUD에 투영되는 정보 중 지시 역할을 수행하는 화살표를 중심으로 이것이 운전 중 시지각 및 인지 작용에 미치는 영향을 알아보고, 향후 안전한 운전을 위한 행동 유도 방향성 제시를 목적으로 한다.

2. 연구 대상 및 방법

선행연구를 따라 조절변수로서의 영향을 알아보기 위해 운전 비숙련자와 숙련자를 대상으로 하였다. 동일한 상황적 조건을 위해 AR-HUD 사용 경험이 없는 성인 30명을 모집하여 아이트래커를 활용한 실험을 진행하였다. AR-HUD의 여러 정보 그래픽 요소 중 방향 안내와 과업을 지시하는 화살표로 연구 대상을 한정하고, 사례분석을 통해 다중 화살표 간격과 속도의 최댓값과 최솟값을 도출하여 이를 바탕으로 실험물을 제작하였다. 실험은 가상 운전 시뮬레이션을 통해 진행되었으며 수집된 정량 및 정성 데이터를 시지각 및 인지적 관점에서 분석하였다.

3. 문헌 연구 및 사례조사

3. 1. AR-HUD 선행연구 조사

자동차의 HUD(Head Up Display)는 운전자에게 필요한 정보를 전달하는 중요한 인터페이스이다. 최근에는 AR(Augmented Reality) 기술이 HUD에 통합되며 이를 AR-HUD라고 부른다. 선행연구 조사 결과(Table 1) HUD의 시각적 표현 방식과 운전 숙련도가 조건에 따라 인지 과부하로 인한 부주의 맹시와 관계성을 보였다.

3. 2. HMI와 디자인 어포던스

HMI(Human Machine Interface)는 인간과 기계 간의 정보 및 신호의 중재자 역할을 한다(Jung, 2020). 자율주행 기술의 발전과 HMI가 1.0단계에서 2.0단계로 넘어감에 따라 어포던스의 개념이 더욱 중요해졌다(Renub Research, 2021). 어포던스는 단순히 사물의 물리적 특성이 아닌, 그 사물이 사용자와의 상호작용 중 어떤 행동을 유도하는지에 중점을 둔 개념이다(Gibson, 1979; McGrenere & Ho, 2000). 이러한 관점에서, 효과적인 HMI 설계는 차량이 운전자에게 어떤 반응이나 행동을 유도하는지에 대한 어포던스 원칙을 깊게 이해하고 적용해야 한다고 강조되고 있다(Jeon, 2020).

3. 3. 운전 시야와 부주의 맹시

사람은 사물을 지각할 때 모든 부분을 선명하게 인식한다고 생각하지만, 실제 사람의 시각 정보처리 능력은 중심부로부터 30°까지 유효하며(Kang, 2016), 그 외 부분은 시신경이 성기게 구성되어 동시에 선명하게 처리할 수 없다(Azzopardi & Cowey, 1993). 운전 시 속도와 숙련도에 따라 시야각은 차이를 보이며(Yoon, 2021), 운전속도가 빠를수록 시야각이 좁아지는 현상이 나타난다(Kotsa, 2009). 즉, 속도가 높을 경우, 운전자는 좁아진 시야로 운전 중 다양한 정보를 동시에 처리해야 한다. 좁아지는 시야에서 인지적 부하가 증가할수록 동공의 크기가 증가하거나 변화하는 경향을 보인다(Beatty, 1982; Koelewijn, Zekveld, Festen, & Kramer, 2012). 또한, 주의력은 한정된 자원이며, 총량의 법칙에 따라, 주어진 정보나 작업의 양이 많아질수록 우선순위가 높은 정보만을 선택적으로 인지하게 된다(Chabris & Simons, 2010). 이러한 상황에서, 예상치 못한 중요한 사건이나 사물을 놓치는 부주의 맹시(Inattentional Blindness) 현상이 발생할 수 있으며, 이는 운전 중 큰 위험을 초래할 수 있다(Kennedy & Bliss, 2013).

3. 4. AR-HUD 방향 지시 사례 수집 및 분석

AR-HUD 방향 지시 현황 분석을 위한 사례 선정 기준은 다음과 같다. 글로벌 브랜드 컨설팅 그룹 인터브랜드가 선정한 2022년 베스트 글로벌 브랜드 순위 100위 내 15개 자동차 기업의 1년 이내 AR-HUD 구현 영상 콘텐츠의 유튜브 업데이트 여부를 파악하여 1차 분류하였다. 콘텐츠를 업로드한 회사 중 방향 지시 방법으로 화살표를 사용하고 있는 기업 4개와 연계 개발 업체 4개의 화살표에 관한 간격과 깜빡임 속도에 대해 분석하였다. Tesla의 경우 AR 내비게이션을 센터페시아1)에서 표시하고 나머지 주요 정보를 Hidden-HUD로 지원하며 Audi의 경우 하나의 화살표가 모든 상황에 적용되므로 제외되었다. 분류에 관한 내용은 Table 2와 같다.

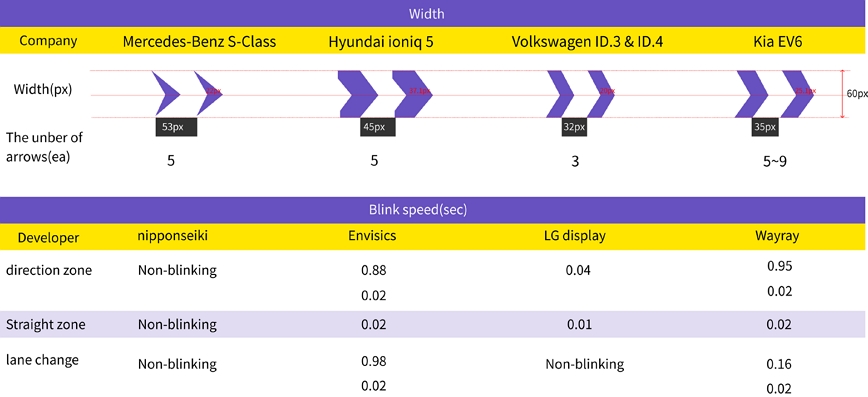

선정 기업의 4가지 화살표 사례에 대해 높이 60px의 동일한 형태 조건에서 간격과 깜빡임 속도를 분석하였으며 그 결과는 Figure 1과 같다.

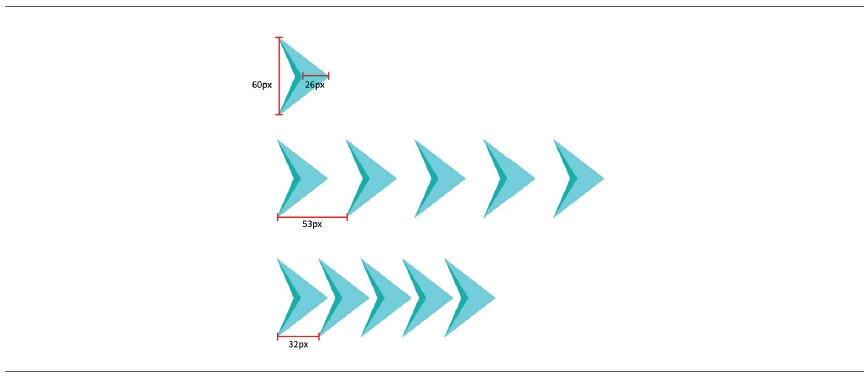

화살표의 형태적 특성과 속도를 분석한 결과 화살표 사이 간격 최대간격 53px, 최소간격 32px로 21px의 차이를 보였으며, 깜빡임 속도 시간의 경우 최대 0.98sec, 최소 0.16sec으로 0.82sec 차이를 보였다. 위 분석을 통해 형태적 평균값을 도출하여 높이 60px, 그림자 제외 세로 25px의 실험물을 Figure 2와 같이 제작하고, 각 화살표에 깜빡임 속도의 최댓값과 최솟값을 적용해 실험을 진행하였다.

4. 연구 방법

4. 1. 연구문제 및 설계

선행연구 조사 결과, AR-HUD의 시각적 표현 방식과 운전 숙련도에 따라 인지 과부하로 인한 부주의 맹시를 유발할 수 있다는 관계성을 파악하였다. 또한 사례 조사를 통해 기업별 화살표의 간격과 속도에 시각적으로 차이가 있음이 조사되었다. 따라서 본 연구를 통해 실증적 분석을 수행하고자 Table 3과 같이 연구문제를 설정하였다.

운전자의 주행속도가 숙련도에 따라 화살표 간격과 속도로 인해 차이가 있을 것으로 예상되었다. 그러므로 도로교통법 제1장 제2조에 따라 2년 미만을 비숙련자, 2년 이상을 숙련자로 구분하고 AR-HUD 사용 경험이 없는 참여자를 대상으로 실험을 진행하였다. 또한 화살표의 유형이 주행속도에 영향을 주는지 관찰하기 위해 참가자들은 자신의 주행속도를 볼 수 없도록 통제되었다.

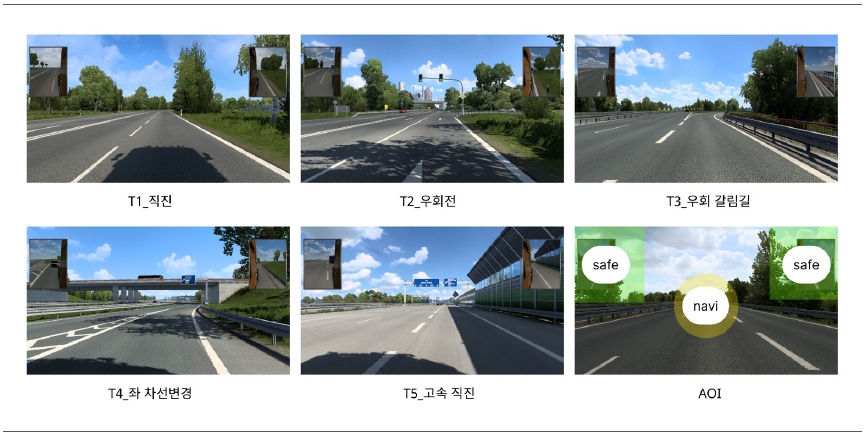

독립변인으로는 화살표의 간격과 깜빡임 속도로 설정하고, 운전 숙련도의 영향을 알아보기 위해 조건별 주행완료 시간과 과업이 주어진 1구간 2구간에서 주행속도를 측정하였다. 종속변인은 전체 주행완료 시간 및 구간별 주행완료 평균 속력으로 설정하였다. 주요 관찰 지표로는 과업이 이루어지는 5개의 주요 구간인 TOI(Time of interest)와 사이드미러 영역 “safe”와 내비게이션 영역인 “navi” 2가지 영역을 AOI(Area of interest)로 설정하고 응시율과 동공 크기를 이용하여 집중도를 측정하였다. 위 구간별 구분은 아래 Figure 3과 같다.

실험 후, 참가자를 대상으로 사용성 평가, 사후 인터뷰 및 관찰을 통해 깜빡임 속도 인지 여부를 파악하고 사고 발생 유무와의 관계를 알아보았다. ISO 9241-11 사용성 가이드(1998)를 기반으로 AR-HUD 사용자 사용성 지표를 통해 직관성, 가독성, 인터랙션 효율성, 인지 부하, 호감도로 나누어 총 12개 항목을 측정했다. 직관성, 가독성 및 인터랙션 효율성을 통해 과업에 대한 이해도를 파악하고, 인지 부하 항목을 통해 인지 작용에 어떠한 영향을 미치는지 알아보았다. 5점 리커트 척도를 사용하였으며 마지막 q12 문항은 인지 유무 판단 질문으로 Y/N 응답으로 진행되었다(Table 4).

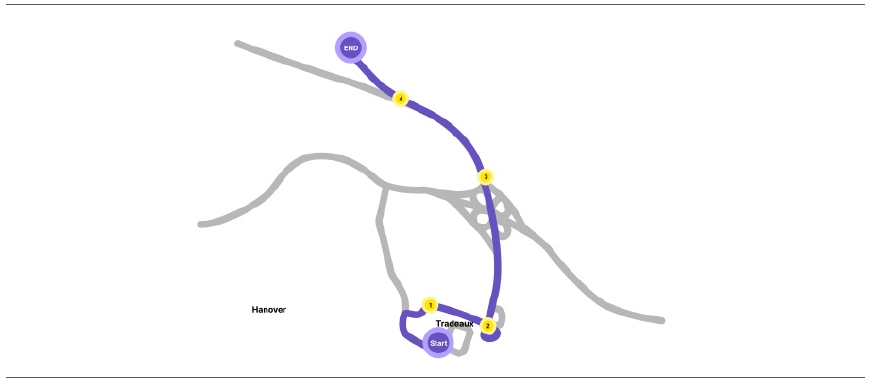

4. 2. 시나리오 및 경로설정

실험에 사용된 운전경로의 총구간 거리는 3.5km이다. 4개 구간으로 구분하였으며 이는 Figure 4와 같다. 1구간과 2구간은 화살표 간격과 속도가 운전자의 주행속도에 어떠한 영향을 미치는지 알아보기 위해 직진과 우회전 커브 과업이 주어졌다. 3구간과 4구간은 인지 부하를 알아보기 위해 직진과 차선 변경 과업으로 구성되었다. 구간별 화살표 속도는 Figure 1의 결괏값을 토대로 1구간 0.98sec, 2구간 0.16sec, 3구간 0.98sec, 4구간 0.16sec로 설정하였다. 2개의 화살표 간격 유형을 각 구간에 적용시켜 진입 및 출입 시간과 총 주행시간을 측정 비교하였다. 1구간과 2구간은 과업 중 구간 최고 속도와 구간 평균 속력을 비교하였다.

실험 시간은 피험자 각각 약 30분 소요되었으며, 피험자는 AR-HUD 경험이 없는 운전 숙련자 18명, 비숙련자 12명, 남, 여 5:5 비율 총 30명으로 구성되었다. 운전자는 두 종류의 화살표 간격, A(32px)와 B(53px)로 설정된 동일한 구간을 2번 주행하였다. 이는 피험자의 각 유형에 대한 행동 패턴을 분석하기 위함이며, 각 유형에 따른 총 주행시간의 변화를 측정하였다. 실험물 순서에 따른 변수를 방지하기 위해 2가지 유형별 실험 순서를 실험 대상자마다 번갈아 제공하였다.

5. 연구 결과

5. 1. 분석방법

연구 결과는 SPSS Statistics 29.0을 사용하여 분석하였다. 중심시에 표시되는 화살표 정보와 관련하여 구간별 시간 및 속력 데이터를 활용하여 상관관계 및 상호관계를 분석하였으며, 사용성에 대해 5점 리커트 척도로 평가 후 독립표본 t-test를 통해 두 집단 간 차이를 비교하고, 기술통계분석을 실시하였다. q8과 q9는 역방향 문항으로 역산출되었다. Shapiro-Wilk 정규성 테스트 진행을 통해 정규성 충족 확인 후 모수검정을 진행하였다. 이원분산분석을 통해 화살표 간격과 속도의 상호관계를 분석하고 위계적 회귀분석으로 숙련도의 조절효과를 알아보았다. 화살표의 인지부하에 대한 영향을 파악하기 위해 아이트래커를 통한 Scan path와 Saccade, Pupil diameter 데이터를 통해 주목하는 대상의 시선 경로와 시선 이동 속도 및 집중도를 파악하였으며, 시선 데이터 평균값의 유의미한 차이를 알아보기 위해 독립표본 t-test를 진행하였다. 관찰을 통해 운전 중 사고 발생 유무를 알아보고 사후 인터뷰를 통해 사고 발생 이유 및 사용성에 대한 심층 인터뷰를 추가로 진행하였다.

5. 2. 연구문제 검증

연구문제 1과 2에 대해 화살표의 간격과 속도는 각각 주행시간에 대해 운전자에게 영향을 미쳤으나, 운전자의 숙련도에 따라서는 차이가 없었다.

화살표 사이가 가까울수록 평균적으로 주행시간이 줄어들었으며, 화살표 사이 간격이 53px에서 32px로 줄어들면 전체 주행시간이 23.7sec 줄어들었다(Table 5). 또한 화살표 깜빡임 속도가 빠를수록 주행시간이 줄어들었으며, 간격별 17.4sec, 18.9sec로 두 간격 모두 약 18초의 차이를 보였다.

화살표 간격과 깜빡임 속도의 상호관계 분석 결과(Table 6), 상호작용의 결과는 유의하지 않았으며(F=0.136, p=0.712), 화살표 간격(F=3.572, p=0.328)과 깜빡임 속도(p=26.190, p=0.556)에 대한 운전 숙련도의 조절효과는 나타나지 않았다. 그러나 화살표 간격(p=0.014, p=0.014, p=0.021)과 깜빡임 속도(p=0.001, p=0.001, p=0.001)가 주행 속도에 각각 영향을 주는 상관관계가 나타났다(Table 7~8).

연구문제 3에 대해 과업 수행 시 화살표 간격과 속도의 상호작용은 나타나지 않으나, 화살표 간격과 속도는 각각 운전 속도에 영향을 줌으로써 상관관계가 나타났다.

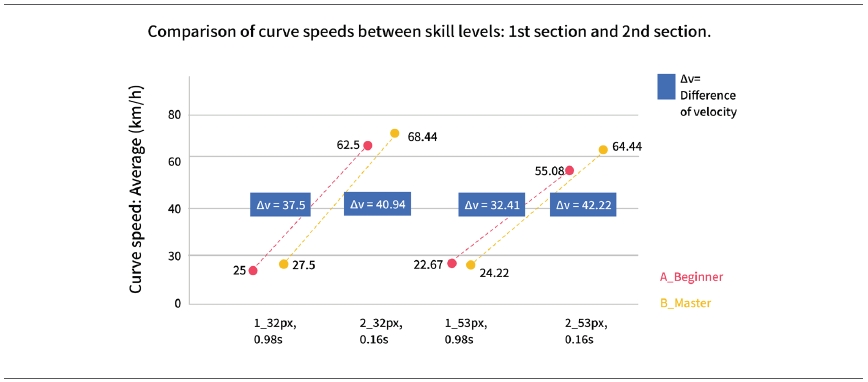

과업 수행 시 화살표 간격과 속도에 따라 차량 평균 속력의 차이가 있는지 알아보았다. 구간별 8가지 경우의 수의 평균 속력을 구하고 숙련자와 비숙련자의 구간별 차이값을 보았으며 이는 Figure 6과 같다.

두 구간의 차량 속력의 평균을 비교해 보면 32px 화살표 간격에서 1구간(0.98sec), 2구간(0.16sec)은 19.5km/h의 주행속도 차이를 보였으며, 53px 간격에서는 29.6km/h의 주행속도 차이를 보였다(Table 9).

과업 수행 시 화살표의 간격과 깜빡임 속도는 주행속도 변화에 유의미한 영향을 미쳤으며(F=31.541, p=.001), 화살표의 간격(F=7.517, p=.007)보다 화살표 깜빡임 속도가(F= 86.737, p=.001) 주행속도에 더 영향을 많이 미치는 것으로 나타났다(Table 10).

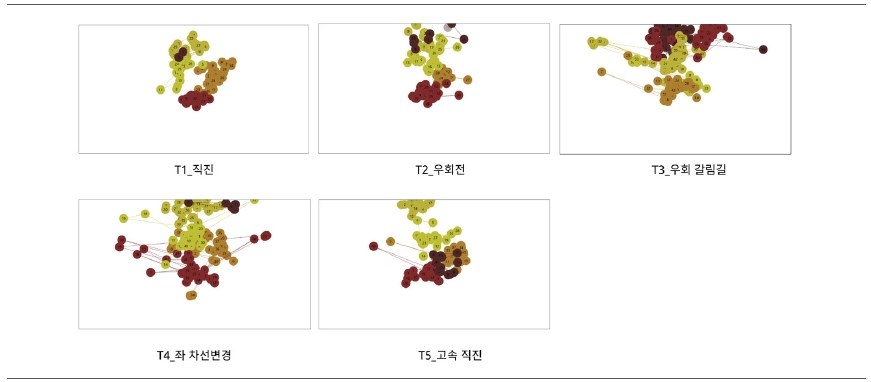

연구문제 4에 관한 시선추적 데이터 분석 결과, 과업 진행에 따라 시선이 좌우로 분산되는 경우가 나타났으며, “navi” 영역에 “safe” 영역보다 사용자의 시선이 더 오래 머물렀다.

5개의 TOI 구간별 AOI의 운전자 시선 경로는 화살표가 위치한 범위를 중심으로 머물렀으며 시선이 좌우로 분산되는 경우는 차선 변경 및 우회 구간에서 나타났다(Figure 7).

“navi”와 “safe” 구간에서의 평균 고정시간은 약 484.355ms의 차이를 보였으며, 시선의 총 지속시간은 537.837ms의 차이를 보이며 “navi”에 시선이 더 오래 머물렀다. 동공의 크기는 “navi” 영역에서 눈동자의 평균 직경이 “safe” 영역보다 크게 측정되어 사용자가 “navi” 영역에 더 많은 주의를 기울였을 가능성이 있다(Table 11). 두 AOI의 독립표본 t-test 결과 평균값(Table 12)의 차이는 통계적으로 유의미한 결과를 보였다(F=18.23, p=0.02).

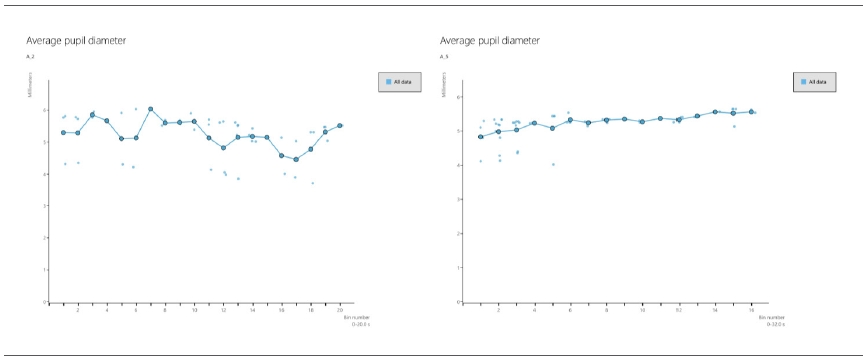

직진 구간과 과업 진행 시 동공 크기 비교 결과는 직진 구간에서 동공의 변화가 적었으며(Figure 8 좌측), 반면 구간의 변화가 일어나는 구간에 대한 과업 수행 시 동공의 크기가 변하였다(Figure 8 우측). 이는 ‘3-3. 운전 시야와 부주의 맹시’에서 동공 크기의 변화가 인지적 부하를 판단할 수 있다고 언급했듯이 과업 수행 과정에서 인지 부하를 겪었을 가능성이 있다고 할 수 있다.

연구문제 5에 관한 가독성(3문항), 인터랙션 효율성(2문항), 인지 부하(4문항) 복수 문항에 대한 신뢰도 분석 결과 크론바흐 알파 계수가 전 항목에서 0.7보다 큰 것이 확인되었으므로 내적 일관성이 확인되었다. 또한 가독성(M=4.05), 인터랙션 효율성(M=4.06), 인지부하(M=3.98)는 리커트척도 3점을 상회하는 긍정적인 평가가 확인되었다(Table 13).

전체 설문 조사 결과 화살표에 대한 참여자는 화살표 안내에 대해 긍정적으로 답변하였으나, 피험자의 70%가 운행 중 화살표에 시선을 뺏겨 사고가 발생했다. 화살표 선호도 조사 결과 전체의 70%가 53px의 간격이 넓은 화살표를 선호하였다. 인지 부하 영역 문항에서도 긍정적인 반응이 나타났는데 화살표가 과업을 수행하는 데 방해되지 않으며 인지가 원활하게 진행되었다고 대답했다. 그러나 설문 결과와 반대로 운행 중 사고 비율은 30명 중 70%에 해당하는 21명의 실험자가 차선 변경 시 뒷차를 보지 못하거나 속도를 줄이지 못해 충돌사고를 일으켰다. 이는 숙련도와 관계없이 일어났으며, 사후 인터뷰 과정에서 21명 중 11명이 화살표를 보느라 사이드미러를 보지 못했다고 응답하였다. 즉, 의식하지 못하였으나 인지적 부하가 있었음을 알 수 있다. 이는 깁슨이 주장한 어포던스의 특징 중 하나로 인지 여부와 상관없이 어포던스가 독립적으로 존재했음을 의미한다. 심리적 측면에서, 응답자 30명 중 9명은 32px의 화살표가 너무 빨라 보기 불편하다는 의견과 심적으로 마음이 불안하거나 긴장감이 든다는 의견을 표했으며, 깜빡이는 속도 때문에 사이드미러를 보지 못할 것 같다는 의견도 있었다.

6. 결론 및 제언

본 연구는 AR-HUD의 정보 요소 중 화살표의 간격과 깜빡임 속도에 따라 운전자의 시지각 및 인지에 미치는 영향을 연구하였다. 연구 결과 화살표의 간격과 깜빡임 속도는 운전자의 시지각 및 인지에 영향을 미치는 것으로 확인되었다. 연구의 결과를 바탕으로 다음과 같은 고려 사항을 제시하고자 한다. 첫째, 화살표의 간격과 깜빡임 속도는 운전 숙련도와 상관없이 주행속도와 상관관계가 있음을(Table 7~8) 확인하였다. 과업 수행 시 화살표 속도의 증가는 주행속도를 높여 사고 위험을 증가시킬 가능성이 있으므로(Table10) AR-HUD 개발 시, 화살표의 속도를 조절하여 운전자의 인지적 부담을 줄이고 안전한 운전 행동을 유도할 수 있도록 해야 한다. 예를 들어 사고 다발 구간, 보행자 및 어린이 보호 구역 등 주의를 요하는 구역에서 화살표 속도를 줄여 적용한다면 안전한 운전 행동을 유도할 수 있을 것이다. 둘째, 운전자의 시선은 주로 화살표가 있는 내비게이션에 집중되며, 사이드미러에 대한 주시 시간이 상대적으로 짧아져 안전한 주행에 방해가 될 수 있다(Table 11~12). 실험에서 나타난 사고율로 미루어 보아 AR-HUD의 화살표 간격과 깜빡임 속도를 적절하게 조절하되, 운전자의 시선 분산을 최소화하는 방안에 대한 추가적인 모색이 필요하다. 사용성 평가 결과에서 AR-HUD는 긍정적인 반응을 보인 만큼 추가적 연구를 통해 안전한 운행을 유도할 수 있는 그래픽 유형에 관한 연구가 진행되어야 할 것이다.

Acknowledgments

본 연구는 2023년 석사학위논문을 바탕으로 작성되었습니다.

This paper was written based on the Master Dissertation Thesis in 2023.

Notes

Copyright : This is an Open Access article distributed under the terms of the Creative Commons Attribution Non-Commercial License (http://creativecommons.org/licenses/by-nc/3.0/), which permits unrestricted educational and non-commercial use, provided the original work is properly cited.

References

-

Azzopardi, P., & Cowey, A. (1993). Preferential representation of the fovea in the primary visual cortex. Nature, 361, 719-721.

[https://doi.org/10.1038/361719a0]

-

Gabbard, J. L., Fitch, G. M., & Kim, H. (2014). Behind the glass: Driver challenges and opportunities for AR automotive applications. Proceedings of the IEEE, 102(2), 124-136.

[https://doi.org/10.1109/JPROC.2013.2294642]

- Giordano, C. (2021). Keep your eyes on the road: AR HUDs for automotive. AEM, 2021(07).

-

Hess, E. H., & Polt, J. M. (1964). Pupil size in relation to mental activity during simple problem-solving. Science, 143(3611), 1190-1192.

[https://doi.org/10.1126/science.143.3611.1190]

- Hyundai Motor Group. (2021, December 27). Safe and convenient from the start to the end of driving. https://www.hyundai.co.kr/story/CONT0000000000005027.

- Jang, G. H. (2023). A study on the type of direction indication in AR-HUD within vehicles. Proceedings of the Korean HCI Society Conference, 329-334.

- Jang, J. H. (2021). AR-HUD interface design based on driving context information. [Unpublished master's thesis]. Yonsei University Graduate School of Communication, Seoul, South Korea.

- Jeon, O. W. (2020). The change of HMI technology in future car interiors. Auto Journal, 42(1), 33-36.

- Jeong, S. H. (2020). A study on the directionality of In-Vehicle Infotainment (IVI) in autonomous vehicles based on driving scenarios. [Unpublished doctoral dissertation]. Hongik University, Seoul, South Korea.

- Jo, S. H. (2022). Design and implementation of an IoT HUD system integrating vehicle and navigation information. [Unpublished master's thesis]. Sangmyung University Graduate School, Seoul, South Korea.

- Jung, S. H. (2020). A study on the directionality of In-Vehicle Infotainment (IVI) in autonomous vehicles based on driving scenarios. [Unpublished doctoral dissertation]. Hongik University, Seoul, South Korea.

- Kang, K. Y. (2016). Higher cognition in central and peripheral visual perception processes. [Unpublished doctoral dissertation]. Yonsei University, Seoul, South Korea.

- Kook, J. J. (2021). Design of an IoT Head Up Display (HUD) system integrating ECU and navigation information. Journal of Semiconductor & Display Technology, 20(3), 172-177.

- Kotas. (2009). The driver's vision and field of view. TS, 2009.05, Safety Column, Traffic Accident Engineering Research Institute, 13-12-03.

- Lee, J. H., & Kim, Y. H. (2014). A study on the interface elements of in-vehicle navigation affecting cognitive affordances. Journal of Digital Design Research, 14(4), 201-210.

- McGrenere, J., & Ho, W. (2000). Affordances: Clarifying and evolving a concept. Proceedings of the Graphics Interface 2000 Conference, Montréal, Québec, Canada.

-

Murphy, G., & Greene, C. M. (2017). Load theory behind the wheel; perceptual and cognitive load effects. Canadian Journal of Experimental Psychology / Revue canadienne de psychologie expérimentale, 71(3), 191-202.

[https://doi.org/10.1037/cep0000107]

- Naujoks, F., Mai, C., & Neukum, A. (2014). The effect of urgency of take-over requests during highly automated driving under distraction conditions. Advances in human aspects of transportation, 7(Part I), 431.

- Park, S. H. (2023, January 5). "The entire windshield as a HUD"...BMW unveils 'i Vision Dee' at CES 2023. Maeil Business Newspaper. https://www.mk.co.kr/news/business/10594535.

-

Romer, D., Lee, Y.-C., McDonald, C. C., & Winston, F. K. (2014). Adolescence, attention allocation, and driving safety. Journal of Adolescent Health, 54(5), S6-S15.

[https://doi.org/10.1016/j.jadohealth.2013.10.202]

-

Wang, Y., Wu, Y., Chen, C., Wu, B., Ma, S., Wang, D., Li, H., & Yang, Z. (2021). Inattentional blindness in augmented reality head-up display-assisted driving. International Journal of Human-Computer Interaction, 38(9), 837-850.

[https://doi.org/10.1080/10447318.2021.1970434]

-

White, C., & Caird, J. (2010). The blind date: The effects of change blindness, passenger conversation and gender on looked-but-failed-to-see (LBFTS) errors. Accident Analysis & Prevention, 42(6), 1822-1830.

[https://doi.org/10.1016/j.aap.2010.05.003]

- Yoon, D. K. (2021). Traffic Accident Engineering Research Institute. Retrieved from https://www.g-enews.com/article/Industry/2021/02/202102101406524175e8b8a793f7_1.