청각장애인의 삶과 커뮤니케이션 방식의 이해 및 사운드얼럿 디자인

연구배경 기술의 발전은 보다 많은 사람들을 연결시켜주고 다양한 교육이나 사회적 기회를 제공해준다. 그러나, 청각장애인처럼 특별한 니즈를 필요로 하는 사람들에게는 주변 사람들의 인식과 시선 뿐 아니라 정보와 기회에 대한 접근성을 구현할 수 있는 하드웨어나 소프트웨어 분야에서의 사회적 장벽이 여전히 존재한다. 본 연구는 국내 청각장애인들의 실제 경험과 이야기를 통해 그들의 관점에서 삶과 소통방식을 이해하고, 문제점과 디자인 가능성을 파악하고자 하였다. 그리고 그들의 독립적인 삶을 지원하기 위한 새로운 기기인 사운드얼럿(SoundAlert)의 디자인을 제안하였다.

연구방법 청각장애인 세 명과 수화통역사 등 총 네 명의 참가자와 비구조적 일대일 심층 인터뷰 방법을 이용하였다(2hr45min). 수집된 데이터는 오픈 코딩(open coding)과 선택 코딩(selective coding)의 두 단계를 거쳐 체계적으로 분석하였다. 그리고, 이를 재해석하여 디자인 주제를 도출한 뒤 아두이노를 이용하여 사운드얼럿 프로토타입을 제작하였다.

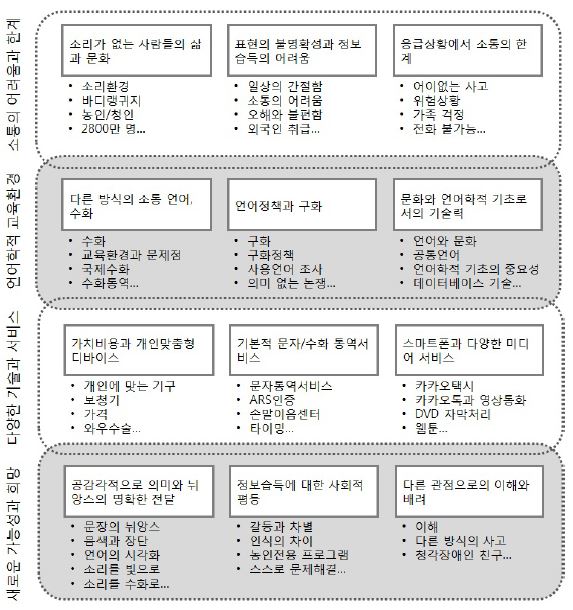

연구결과 오픈 코딩 분석 결과는 총 197개의 텍스트 유닛으로 구분되어, ‘소리환경’, ‘소통의 어려움’ 등 60개의 코드로 나타났다. 선택 코딩을 통한 두 번째 분석 결과는 ‘T1. 소리가 없는 사람들의 삶과 문화’, ‘T4. 다른 방식의 소통언어, 수화’ 등 12개의 주제로 나타났다. 이 주제들은 네 개의 핵심 범주에 도식적 관점(schematic view)으로 구성되었다; (a)소통의 어려움과 한계, (b)언어학적 교육환경, (c)다양한 기술과 서비스, 그리고 (d)새로운 가능성과 희망이다. 이러한 체계적 분석결과는 디자인 주제(design themes)로 재해석되어, (i)응급상황에서의 즉각적 시스템 요구, (ii)수화교육의 체계적인 기술적 접근, 그리고 (iii)정확한 소통을 위한 소리정보의 시각화로 정리되었다. 그리고 첫 번째 주제의 한 부분으로서 사운드얼럿(SoundAlert) 컨셉과 작동원리를 이용한 프로토타입을 개발하였다.

결론 청각장애인 심층인터뷰 방법과 분석 방법은 성공적이었다. 다학문적 접근으로 재해석된, 세 가지 디자인 주제 내용은 유저와 디자이너의 코-크리에이터(co-creator) 및 향후 디자인의 전략적 가이드 역할을 할 수 있을 것이다. 사운드얼럿(SoundAlert)은 IoT와 연계하여 실제 청각장애인들과의 현장 조사를 진행할 계획이다.

Abstract

Background Technology has the potential for connecting people and providing various educational or social opportunities. For people who are deaf and hard of hearing (DHH), however, there are social barriers on the internet, in software, and in hardware that can limit access to information and opportunities. The aim of the study is to understand the life and communication of DHH and to identify design spaces for DHH in order to support their independent lives and to design SoundAlert.

Methods Non-intrusive, in-depth interviews, each of which lasted two hours and forty-five minutes, were conducted with four participants (three DHH and one sign language interpreter). The data were analysed for illustrating schematic view using open coding and selective coding systematically. Workshops were conducted with cross-disciplinary experts for reinterpreting the results into design spaces. Arduino was used for the SoundAlert prototype.

Results The analysis of 197 units of a section resulted in 60 codes including “life without sound” and “communication difficulties.” After the second analysis, 12 themes emerged (“Life and culture of DHH”, “Different way of communication, Sign language,” etc.) and were placed into four key categories including “Educational environment of linguistics” and “Diverse service and technology”. The results were reinterpreted into design themes involving “Emergency communication system” and the “Visualisation of sound information.” As part of the former, the SoundAlert prototype was developed.

Conclusions The interview was successful in triggering diverse episodic, present and future stories told. The systematic analysis results were reinterpreted for designing. This process exemplifies the role of users and designers as “co-creators” in developing design strategic guidelines. Further field study on the SoundAlert will be carried out with DHH.

Keywords:

DHH, Ethnography, Open Coding, Selective Coding, GTA, Qualitative Research, Prototyping, 청각장애인, 에쓰노그래피, 근거이론분석, 정성연구, 프로토타입1. 연구의 배경 및 목적

우리는 일상생활에서 IoT와 AI 기술을 자연스럽게 접할 수 있는 4차 산업혁명의 시대에 살고 있다. 이러한 기술들은 다양한 사람들을 연결시켜, 교육이나 사회적 기회를 제공할 수 있는 잠재력을 가지고 있다. 그러나 특히, 청각장애인(Deaf and Hard of Hearing)처럼 특별한 니즈를 필요로 하는 사람들에게는 잘 드러나지 않는 사회적 장벽이 여전히 존재한다. 그 장벽은 정보와 기회에 대한 접근성(accessibility)을 제한할 수 있는 인터넷뿐만 아니라, 하드웨어/소프트웨어 분야에서(Kaye, 2000), 또는 주변 사람들의 시선과 태도에서도 나타날 수 있다.

청각장애인들의 독립적인 일상생활에 도움을 주고자 디자인된 최초의 기술은 1876년 알렉산더 그레이엄 벨(Alexander Granham Bell)의 전화기였다. 전자파를 이용하여 보내는 사람의 목소리를 청각장애인에게 좀 더 쉽게 잘 들을 수 있도록 발명한 것이다. 그런데, 이 전화기는 서로의 얼굴을 볼 수 있는 기회를 줄어들게 하여 청각장애인들에게 환영받지 못했다. 1960년대에 들어 청각장애인 과학자, 로버트 바이브레히트(Robert Weitbrecht)가 음향 모뎀(acoustic modem)과 음향 결합기(acoustic coupler)를 발명하면서, 청각장애인들의 텔레타이프기기 (teletype machine, TTY) 역할을 한 것이다(Lang, 2000). 그러나 이러한 기술이 청각장애인들의 사회적 참여를 넓힐 수 있는 기회로 활용되지는 못했다. 텔레타이프기기(TTY)나 텔레커뮤니케이션기기(TDD)는 그것을 소유하고 있는 사람들에게만 제한적으로 활용되었다(Maiorana-Basas & Pagliaro, 2014).

오늘날 많은 사람들이 컴퓨터와 모바일 기술을 이용하여 교육, 비즈니스, 그리고 엔터테인먼트 등 다양한 정보를 습득한다. 국내 인터넷이용 실태조사(2016)에 따르면, 인터넷 이용률은 88.3%로, 사용자의 가장 큰 이용목적은 ‘커뮤니케이션(91.6%)’이었으며, ‘여가활동’과 ‘자료 및 정보 획득’이 각각 89.1%로 나타났다. 한편, 모바일 인터넷이용률은 85.9%로, 인스턴트 메신저 이용률이 92.5%, 소셜네트워킹서비스(SNS) 이용률은 65.2%로 나타났다. 특히, 인스턴트 메신저는 대화(100%)의 기능을 넘어서, ‘사진, 동영상, 스케줄 등을 공유’(80.9%)하고, ‘음성 및 영상통화’(44.0%) 기능도 활용되고 있었다. 대부분의 사람들이 시간과 공간의 제약 없이 다양한 방식으로 커뮤니케이션 미디어를 활용하고 있다는 것이다. 그러나 청각장애인인 경우 이러한 다양한 정보를 습득하기에는 한계가 있다. 미디어에 캡션이 없는 경우가 많기 때문이다. 이러한 문제는 궁극적으로 사회적 격차를 크게 만들 것이다.

국내 등록 청각장애인 수는 255,399명 (통계청, 2014)이다. 특히, 청각장애 아동인 경우 언어습득을 위해서는 충분한 시각적, 언어적 자극을 주는 등의 적절한 교육적 서비스 제공이 필수적이다. 발음기관을 통한 언어 표현 능력은 쉽게 습득되는 것이 아니다. 정상적인 발달단계를 거치면서 꾸준히 향상되며 주변 사람들과의 지속적인 상호작용을 통해 자연스럽게 형성된다. 그러나 청각장애 아동인 경우 어렸을 때부터 기질적인 요인이나 환경적인 요인 때문에 언어적 결함을 갖게 되는데, 이러한 문제는 궁극적으로 타인과의 의사소통뿐만 아니라 사회생활 전반에 다소 어려움을 느낄 수 있다(Kim et al., 1994). 그들은 자신감 부족과 불안감 등의 심리적 장애를 겪기도 하지만, 일상생활에 대한 체험 부족으로, 언어에 대한 두려움을 가질 수도 있다(Kilgour et al., 2015).

본 연구에서는 국내 청각장애인들의 실제 경험을 통해 그들의 관점에서 삶과 소통방식을 이해하고, 문제점과 니즈를 파악하고자 한다. 이를 위해, 청각장애인들을 대상으로 일상생활에 대한 다양한 이야기를 2장에서 심층 인터뷰 방법을 통해 들어본다. 특히, 청각장애인들에게 기존 서비스 디자인 사례를 소개하면서 구체적인 반응을 살펴보고, 미래 기술의 가능성을 이야기하도록 한다. 수집된 인터뷰 데이터는 3장에서 근거 이론 분석 (Grounded Theory Analysis, Chamaz, 2006) 방법을 통해 두 가지 단계를 거쳐 ‘체계적인 데이터 구조’로 표현될 것이다. 4장에서는 인터뷰 분석 결과에 대한 디자인 영역으로의 활용 가능성을 논의하고(Monk & Gilbert, 1995), 그 결과의 한 부분으로서 사운드얼럿(SoundAlert) 컨셉과 프로토타입을 소개할 것이다.

2. 심층 인터뷰 방법

본 연구 방법은 청각장애인을 만나 일대일 비구조적 인터뷰를 진행하는 것이다. 인터뷰 목적은 그들의 커뮤니케이션 방식, 기존 서비스 디자인 사례에 대한 반응, 그리고 미래 기술에 대한 바람 등 세 가지 관점의 경험담과 솔직한 에피소드를 데이터로 수집하는 것이다.

2. 1. 인터뷰 스케줄

본 연구는 인터뷰 참여자를 위한 사전 동의서를 바탕으로 성균관대학교의 생명윤리위원회 승인을 거쳐 진행되었다. 사전 동의서는 연구 참여자에게 다음의 세 가지 내용을 명확히 알리고 있다: (i) 인터뷰 내용은 녹음될 것이며, (ii) 참여자가 동의서에 서명한 이후에도 더 이상 연구 참여를 원하지 않는다면 언제든지 알려달라는 것과, (iii) 그럴 경우 인터뷰는 바로 중단될 것이며, 그때까지 저장된 데이터도 모두 삭제될 것이라는 내용이다. 인터뷰는 모바일폰의 음성 메모(Voice Memos) 기능을 이용하였고, 음성 데이터를 텍스트 데이터로 변환하는 시점에 참여자의 이름을 성별에 따른 가명으로 바꾸었다(Table 1). 모든 인터뷰 참여자 정보는 저자 외의 다른 어떤 사람도 접근할 수 없도록 안전하게 저장되었다.

인터뷰는 네 명의 참여자들로부터 모두 사전 동의를 얻고 시작되었으며, 철저히 참여자의 의도에 거스르지 않는(non-intrusive) 범위 내에서 세심하게 진행되었다(Table 1). 그 중 세 명은 사회적 기업에서 청각장애인들을 위한 미디어 콘텐츠를 제작하는 20대 초중반의 여성 청각장애인들로, 인터뷰를 바로 옆에서 수화통역사와 함께 진행되었다. 인터뷰는 모두 열린책장사무실1)에서 진행되었다. 인터뷰 스케줄은 다양한 주제의 대화를 자연스럽게 유도하기 위한 방법으로 구성되었으며(Kim, 2016), 인터뷰 음성화일은 모두 텍스트 파일로 변환된 후 분석되었다 (Strauss & Corbin, 1998; Chamaz, 2006; Mortensen, 2018).

인터뷰는 대화하는 방식과 비슷하기 때문에, 인터뷰 결과는 참여자의 대답에 어떻게 반응하고 덧붙이면서 다시 질문을(follow-up questions) 던지느냐에 달려있다. 또한, 인터뷰 분석 결과도 어느 정도 주관적 해석에 의존하지만(Kvale, S., 2006), 데이터가 충분히 수집되면 과학적으로 보이는 데이터 해석을 바탕으로 정성적 접근을 꾀하는 방법론(Young, I., 2008)이 가능해진다.

본 연구에서는 인터뷰 질문 내용을 크게 네 가지 영역으로 구성하였다 (Table 2). 인터뷰 과정은 과거의 경험적 에피소드에서 시작하여, 현재 일상생활의 문제점과 니즈를 자연스럽게 이야기할 수 있도록 유도하며, 미래 기술에 대한 가능성을 언급하도록 구성되었다.

첫 번째는 서로 간단히 소개하면서 최근 소통 문제로 기억나는 에피소드가 있으면 이야기해달라고 부탁한다. 두 번째는 일상생활에서 경험한 크고 작은 문제점이나 불편했던 기억들, 그리고 현재 사용하고 있는 서비스 기술의 장단점에 대해 이야기해달라고 한다.

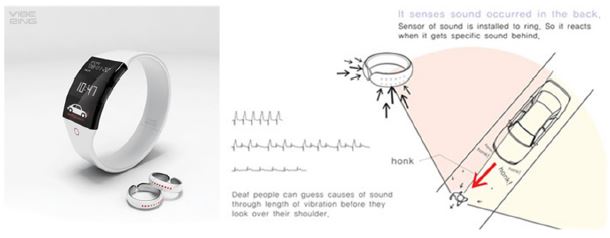

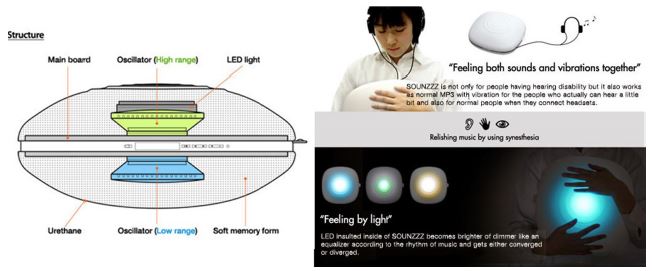

셋째는 본 연구에서 준비한 청각장애인을 위한 기존 서비스 디자인 사례 네 가지를 그림으로 보여주면서 각각 하나씩 간단히 소개해준다. 그리고 그들의 반응에 부합하여 대화를 많이 할 수 있도록 유도한다. 서비스 사례는 Table 3과 같이 쉐어타이핑 글래스(Share typing glass), 트랜센스 (Transcense), 바이브링 센서(Vibering sensor), 그리고 사운즈 (SOUNZZZ)이다. 넷째는 더 나은 미래의 서비스에 대한 솔직한 이야기를 들려달라고 하며, 감사 인사를 한 후 인터뷰를 마무리한다.

2. 2. 기존 서비스 디자인 사례

기존 서비스 디자인 사례 중 두 가지는 실제로 작동하고 활용되는 워킹 프로토타입(working prototype)이며, 마지막 두 개는 컨셉 디자인(concept design)이다(Table 3).

우선, 쉐어타이핑 글래스(Share typing glass)는 말로 표현되는 청각 정보를 문자 정보로 변환시켜 보여주는 기능을 한다(Figure 1). 쉐어타이핑은 실시간 자막을 제공하며, 현재 강연회, 공청회, 세미나 등에서 활용되고 있다(Lee, J., 2015).

트랜센스(Transcense)는 여러 대화 상대의 말을 문장단위로 인식해, 실시간으로 스마트폰 화면에 문자로 보여주는 서비스이다(Figure 2). 여러 사람이 각자의 스마트폰 음성 인식 기능을 사용하여 대화가 서로 겹치지 않고 원활하게 진행되도록 디자인되었다(Lee, C., 2015).

세 번째 사례, 바이브링 센서(Vibering Sensor)는 두 개의 반지와 손목시계 형태로 주변 소음을 인지할 수 있도록 돕는 웨어러블 알람 유닛(alarm unit) 컨셉 디자인이다(Figure 3). 반지는 자동차 경적소리 등 특정 소음을 진동방식으로 알려주며, 손목시계는 소음 정보를 시각적으로 표현하여 전달해준다.

사운즈(SOUNZZZ)는 청각장애인도 음악의 즐거움을 경험할 수 있도록 디자인된 mp3플레이어로, 시각과 촉각을 공감각적 미디어로 표현해준다(Figure 4). 청각장애인들은 비록 소리정보를 귀로 들을 수 없지만, 음악은 일련의 진동과 빛으로 전환될 수 있다. 따라서 사용자가 사운즈를 안고 있을 때, 음악의 강약과 리듬을 빛/색의 시각 정보와 촉각 정보의 지속적 변화로 느낄 수 있도록 디자인되었다(Tran, 2009).

Table 3은 이제까지 기술된 네 가지 서비스 디자인 사례의 기능과 형태를 요약하여 정리한 것이다.

3. 인터뷰 데이터 분석 결과

인터뷰 데이터 분석은 크게 두 가지 단계로 진행되었다. 첫 번째는 청각장애인들의 삶과 소통에 대한 데이터의 다양한 속성과 연관관계들을 확인하고 분류하기 위해 근거 이론 분석(Grounded Theory Analysis, Strauss & Corbinn, 1998; Chamaz, 2006) 중 오픈 코딩(open coding)을 이용하였다. 모든 텍스트 데이터는 의미 단위(unit of meaning)로 나뉘어 197개의 텍스트 유닛(section of text)과 60개의 코드가 나타났다. 코드 사례로는 ‘소리환경’, ‘일상의 간절함’, ‘소통의 어려움’, 그리고 ‘언어의 시각화’ 등이 포함되었다. 두 번째 단계에서는 청각장애인들의 소통에 대한 도식적 관점(schematic view, Strauss & Corbin, 1998)을 핵심적 범주와 주제들로 구성하기 위한 선택 코딩(selective coding) 과정을 거쳤다.

Figure 5는 ‘T1. 소리가 없는 사람들의 삶과 문화’, ‘T2. 표현의 불명확성과 정보습득의 어려움’ 등 12개의 주제 및 각각의 주제와 연관된 코드들이 네 개의 범주 내에 체계적으로 구조화된 모습을 보여준다. 하나의 주제는 세 개에서 다섯 개 정도의 코드를 포함하고 있다. 여기서 T#는 데이터 분석 결과로 나타난 주제(theme)를 구분하는 숫자이며, s#는 인터뷰 데이터 유닛으로 의미 단위를 구분하는 숫자이다. 주제(T#)를 설명할 때 s#는 대표적인 인터뷰 사례와 함께 언급된다.

Figure 5에서 네 가지 핵심 범주들은 (i) 소통의 어려움과 한계, (ii) 언어학적 교육환경, (iii) 다양한 기술과 서비스, 그리고 (iv) 새로운 가능성과 희망으로 구성되었다. 구체적인 내용은 다음과 같다.

3. 1. 소통의 어려움과 한계

첫 번째 범주, ‘소통의 어려움과 한계’는 소리가 잘 들리지 않는 청각장애인들의 일상적 삶의 단편적 모습들과 그들이 경험하는 소통의 근본적인 문제점들을 다음과 같이 세 가지 주제로 다루고 있다.

우선, ‘T1. 소리가 없는 사람들의 삶과 문화’는 선천적으로 들리지 않아 언어장애가 있는 ‘농인’과, 후천적 사고로 청각에 장애를 가진 ‘청인’으로 구성된 사람들의 일상적인 모습을 대표한다. 예를 들면, 소리가 없는 삶에서는 아이의 울음소리에 즉각적으로 반응할 수 없는 상황이 발생할 수 있다.

"애가 쿵 소리를 내며 넘어져서 막 우는데 [어른들은] 평화로워요 ... 애가 피가 나는데, 웃고 떠들고 있는 거예요. [우는] 소리를 들은 사람들은 다 뛰어갔지만.." [s80][a]

둘째,‘T2. 표현의 불명확성과 정보습득의 어려움’은 청각장애인들의 소통방식이 명확하지 않기 때문에 나타나는 근본적인 어려움과 불편함으로 나타났다. 청각장애인들은 주로 기질적인 요인이나 환경적인 요인으로 인해 발음기관을 통한 언어 표현 능력에 결함을 가질 수 있는데, 주위 사람들과의 상호작용을 통해 자연스럽게 형성되어야 하는 표현 언어 발달 과정에서 문제가 있기 때문이다 (Kim et al., 1994; Kim, 1993).

“택시 탈 때 외국인이냐고 물어봤어요. 그리고 약국에서 뭐 사려 했는데 한자로 써줬어요. 중국인인 줄 알고... 말하는 게 정확하지 않으니까 듣는 사람도 어색하게 느꼈나 봐요." [s91][b]

특히, 주변 상황을 소리를 통해 쉽게 인지할 수 있는 일반인들과 달리 청각장애인들은 ‘T3. 응급상황에서 소통의 한계’로 인해 치명적 사고에 노출될 가능성이 높다는 것을 보여준다.

“불이 나서 사이렌이 되게 많이 켜지고 소방차 열 몇 대가 왔거든요. [전] 나갔다가 깜짝 놀라서 왔는데, 아이들은 치킨 먹고 있더라고요... 되게 어이없는 상황..." [s71][a]

응급상황에서의 즉각적 시스템의 필요성은 청각장애인의 ‘환경적 의사소통 수단 접근성의 한계 (Oh & Seo, 2016)’에서 ‘긴급 시스템 부족’과, ‘공공시설에서 의사소통 편의시설 요구’라는 코드에서도 확인되었다. 청각장애인들은 고속도로나 여행지에서 교통사고 등 위험한 상황이 발생했을 때 의사소통의 부재로 인한 어려움을 훨씬 크게 겪을 수 있다는 것이다. 이러한 문제는 상황인식 기술이나 스마트 보조 기술 (Context-awareness, Schilit et al., 2002; Gretton & Honeyman, 2016) 등의 도움으로 다양하게 접근될 필요가 있다.

3. 2. 언어학적 교육환경

두 번째 범주인 ‘언어학적 교육환경’은 국내 청각장애인들의 소통 언어 방식에 대한 교육환경 및 언어정책 전반에 대한 현실적인 문제점과 해결방법에 대해 다각적으로 다루고 있다.

우선, 사람들 사이에서 표정과 손동작을 이용하여 의미를 전달하는 ‘T4. 다른 방식의 소통 언어, 수화’는 새로운 문화와 삶에 대한 사고방식을 배우듯 장기적이고 체계적인 접근이 필요함을 강조하고 있다.

“선생님이 수화를 잘 몰라요...” [s29][c]

“... 몇 번의 실패 끝에 우리가 설문조사한 방식은 설문지를 청각장애인과 함께 만드는 거였어요. 청각장애인들을 모아놓고 수화통역사가 ppt를 띄우고 하나하나 설명하면서 설문을 진행했어요. 보다 정확한 그들의 언어로 설문을 진행해야하니까요.” [s23][a]

이운영(Lee, 2017)에 따르면, 국내에서는 2016년 ‘한국수화언어법’이 제정되어 수화가 독립된 하나의 언어로서의 지위를 보장받게 되었다. 특히, 기본이념 제2조 3항에 따르면, 한국수어사용자는 모든 생활영역에서 한국수어를 통하여 삶을 영위하고 필요한 정보를 제공받을 권리가 있다고 밝히고 있다. 이것은 청각장애인들이 공공장소를 방문할 때 수화를 사용하여 원하는 일을 수행하고 정보를 습득할 수 있도록 제도적인 뒷받침이 마련되어야 한다는 뜻이다. 그러나 한국의 수화교육은 민간 차원에서 산발적으로 진행되어 왔으며 전문 인력은 매우 부족한 실정이다 (Park, 2011; Whang, 2009).

둘째, ‘T5. 언어정책과 구화’는 국내 구화정책에 대한 비판적 내용을 다루고 있다. 이 주제는 구화 중심 교육보다는 수화/구화 통합교육이 정보습득에 훨씬 더 효과적이라는 박종미(2011)의 연구 결과와 같은 맥락으로 해석된다.

“스웨덴 같은 나라의 경우 애가 청각장애인이면 아이가 수화를 쓰게 해주고 부모가 수화를 배워야하는 환경인데, 우리나라는 수화를 쓰는 것을 배척하는 경향이 있어요. 청각장애인 [교육] 환경이 ... [안타까운] 경우가 너무 많아요. 청각장애인 학교인데 수화를 쓰지 말라니..” [s18][a]

셋째, ‘T6. 문화와 언어학적 기초로서의 기술력’이라는 주제는 수화를 이해하는 방식이 다른 문화에서 사용되는 언어의 표현 기법을 이해하는 방식과 유사하다는 내용을 다룬다. 이것은 서도원(2007)의 특정 지역 수화의 어휘 특성에 관한 조사에서도 나타났는데, 각 지역 안에서 오랫동안 거주하여 형성된 언어의 동질성은 개인적 차이가 아닌 지역 문화를 배경으로 한 다른 집단의 언어와 비교했을 때 차이가 있다는 것이다. 따라서 플레이펌프(PlayPumps, Chambers, 2009; Borland, 2011)의 사례처럼, 어떤 상황에서 간단한 스토리를 담는다 하더라도 언어학적 기초가 확실히 마련되어 있지 않으면 청각장애인들이 공감하고 이해하기 어려워한다는 것이다.

여기서, ‘언어학적 기초로서의 수화’ 교육은 글을 읽고 쓸 줄 아는 능력을 향상시킨 후 이것을 수화교육으로 연결시키는 체계적 방법이 중요하다는 것을 강조한다(Kim et al., 1994). 따라서, 로젠블랫(Rosenblatt, 1988)의 언어능력향상 이론 모델인 ‘상호간 공통으로 정의하는 관계로서의 읽기/쓰기’는 청각장애인들에게 도움을 줄 수 있을 것으로 본다. 이 모델은 청각장애인을 위한 텍스트 기반 메시징 서비스(IM, email, SMS)나 수화교육 콘텐츠(Jung & Han, 2008) 설계에도 도움이 될 것으로 기대된다.

한편, 수화교육과 관련된 또 다른 기술적 접근은 청각장애인과 비장애인간의 자연스러운 소통에 초점을 둔 것이다. 로체스터 대학 사야드 아메드(Ahmed, 2017) 연구팀의 AI 딥 뉴럴 네트워크(deep neural networks)를 이용한 동영상 캡션 시스템은 미국 수화를 텍스트로 번역해 화면에 보여주는 방식이다(Figure 6a). 그리고 워싱턴대학 아조디와 프리어(Navid Azodi & Thomas Pryor)가 개발한 사인얼라우드 (SignAloud, O’Hare, 2016)는 미국 수화를 말(speech)로 표현해주는 음성 변환 시스템이다(Figure 6b,c). 이러한 기술적 개발이 국내 수화로도 응용이 가능하도록 지속적인 연구개발이 필요할 것이다.

3. 3. 다양한 기술과 서비스

세 번째 범주, ‘다양한 기술과 서비스’는 현재 청각장애인들의 삶에 도움을 주고 있는 디바이스나 서비스 사례들을 다루고 있다. 우선, ‘T7. 가치비용과 개인맞춤형 디바이스’는 보청기와 와우수술에 대한 사례가 포함되는데, 개인의 니즈나 문제점을 명확하게 파악하여 철저히 개인이 원하는 방식으로 디자인할 필요가 있다는 내용을 담고 있다 (Sparrow, 2005).

“귀 뒤를 열어 칩을 심고 자석으로 와우를 붙이면 소리를 듣는 게 아니라 진동으로 골전도 방식으로 [정보를 습득] 하는 건데, 그 수술하면 무조건 천 만 원 이상 들어가고... 국가에서 웬만큼 지원되고, 다들 권하고... 할 수 밖에 없는 상황인거죠...” [s33][a]

둘째, ‘T8. 기본적 문자/수화 통역서비스’는 청각장애인들에게 가장 기본적으로 필요로 하는 핵심 서비스로 ‘문자통역서비스’, ‘타이밍’, ‘손말이음센터’ 등의 코드를 포함하고 있다.

“ARS 인증할 때 꼭 손말이음센터 필요해요... 청각장애인이 영상통화를 하면 그 분이 헤드셋을 끼고 그 말을 알아들은 다음에 전화를 대신해주는 서비스에요.” [s102][d]

셋째, ‘T9. 스마트폰과 다양한 미디어 서비스’는 ‘카카오택시’나 ‘카카오톡과 영상통화’ 등 모바일폰 애플리케이션 서비스의 활용과, 청각장애인용 ‘DVD’와 ‘웹툰’ 등 엔터테인먼트 미디어를 다루고 있다.

"옛날에는 메모를 준비했는데... 카카오택시처럼 목적지 설정해서 바로 타고 갈 수 있는 건 좋아요.” [s175][b]

“저희 웹툰 본 적 있어요? ho! 우리는 제목부터 DEAF에요. 소문자는 병리적인 청각장애인인데 대문자로 썼잖아요. ‘우리는 농문화에 살고 있는 사람들이다, 소리가 없는 문화에 살고 있는 사람들이다’라는 정체성을 나타내기 위해 큰 대문자를 써요.” [s6][d]

3. 4. 새로운 가능성과 희망

네 번째 범주, ‘새로운 가능성과 희망’은 청각장애인의 관점에서 바라보는 디자인의 가능성과 바람을 다루고 있다. 특히, ‘T10. 공감각적으로 의미와 뉘앙스의 명확한 전달’과 관련된 데이터는 기존 서비스 디자인 사례(Table 3)에 대한 다양한 반응의 분석 결과로 나타났으며, ‘음색과 장단의 다양성’, ‘문장의 뉘앙스 표현’, ‘소리를 빛으로 표현’, ‘소리를 수화로 표현’ 등의 코드가 포함되었다.

"... 데시벨이 아니라, 내 뒤에 뭐가 있는지 그림으로 나타내주면 좋겠어요, 후방카메라처럼. 뒤에 자동차가 있으면 자동차모양이, 사람이 부르면 사람모양 뭐 이렇게 뜨고..." [s204][c][Vibering Sensor]

“... ‘안녕하세요’도 뉘앙스가 있잖아요. 만약에 문자로, ‘안!녕하세!요’라고 보여주고 진동이랑 같이 그 느낌을 표현해주면, ‘아, 이런 느낌이구나’ 하고 알 수 있지 않을까요?” [s166][d][Share typing glass]

“...시각이나 촉각 둘 중 하나만이 아니라 두 기능이 동시에 있었으면 좋겠다고. 그러니까 진동만 있을 경우에는 이게 뭔지 모르고 시각만 있을 때도 마찬가지로 흥미라고 할까요? 그게 조금 떨어지는 것 같다고. 두 개가 동시에 있으면 재미있을 것 같다고.” [s164][b][SOUNZZZ]

다음은 ‘T11. 정보습득에 대한 사회적 평등’으로 농인전용 프로그램, 정보 평등에 대한 바람 등을 다루고 있다. 이 주제는 정보화 수준이 청각장애인의 역량강화에 얼마나 많은 영향을 미칠 수 있는가에 관한 연구에서도 확인되었다(Park, 2011).

“... 요즘 한국사회가 특히 더 정보를 습득하는 게 너무 빠르잖아요. 흘러가는 것도 너무 빠르고... 여기서 농인은 청인들보다 정보습득력에 있어서 현저하게 뒤떨어져요. 농인들도 빠르게 정보를 받아들일 수 있도록 사회적 구조나 환경이 [평등하게] 조성됐으면 좋겠어요.” [s180][b]

“이제 모든 TV 프로그램을 수화로 했으면 좋겠고... 영화는 모든 소리가 자세하게 자막처리 되어 나오면 좋겠어요.” [s151][c]

마지막으로, ‘T12. 다른 관점으로의 이해와 배려’는 다른 방식의 사고를 통해 청각장애인들의 들리지 않는 문화를 이해하기를 바라는 내용을 다루고 있다. 예를 들면, 수화를 배우러 다니면서 ‘청각장애인 친구’들을 만나는 것, 마음을 열고 ‘갈등과 차별’이 있다는 것을 인식할 수 있어야 ‘진정한 이해’가 가능하다는 것 등이다. 더 나아가, ‘인식의 차이’는 청각장애인을 바라보는 관점이 달라질 수 있는 시작점이 되며, 더 나은 삶을 도와줄 수 있는 방법도 다양해질 것이라는 내용을 담고 있다. 이 주제는 ‘비장애인의 인식 전환을 위한 사회제도적 토대가 마련되어야 한다’는 박종미의 주장과 일치한다(Park, 2011).

"청각장애인을 바꾸려 하지 말고 우리를 바꾸는 것으로 생각해봐도 되요. 시각장애인을 위한 점자블록 있죠? 노란색이죠? 왜 노란색일까요? 우리보라고 만든 거라는 생각이 어느 순간 들었어요. 우리가 알아야지. 그게 시각장애인들 실제로 가는 데도 도움이 되겠지만, 기술로 눈 감고 움직여서 다 되는 그런 거면 되는데, 무인자동차 무인소형 스쿠터를 만드는 게 낫지 생각도 하지만 ... 근데 그 사람들이 있다는 것을 인식시키기 위해서 노란 블록이 있는 거 아닐까요? 그 사람들을 이동할 수 있게 만들어주는 게 아니라, '우리가 있다'라는 것을 인식시켜 주는 게 제일 크다고 봐요. 디자인을 하려면 그런 쪽으로...” [s39][a]

4. 디자인 주제에 대한 재해석 및 사운드얼럿(SoundAlert)

사용자 중심 디자인에서 문제점 중 하나는 에쓰노그래픽 연구와 다른 사용자 연구 결과들을 어떻게 효과적으로 요약하여 디자인 아이디어로 전달하고 발전시키느냐에 관한 것이다. 이것은 매우 복잡하기 때문에 에쓰노그래픽 연구 결과와 디자인 명세서(design specifications) 사이의 갭(gap)과 관계를 간단하게 보여주기는 쉽지 않다(Monk & Gilbert, 1995). 이 과정에서 활용되는 일반적인 접근 방법 중 하나는 추상적이고 개념적인 사용자 요구사항을 간단한 문서로 표현하는 것이다. 그러나 이것은 자칫 지나치게 연구 결과를 축소시키는(reductive) 접근이 될 수 있으며, 사용자 니즈에 대해 이야기했던 인터뷰 데이터의 의미와 가치를 잃어버릴 수도 있다는 단점이 있다(Kim et al., 2013).

4. 1. 디자인 주제에 대한 재해석

본 연구에서는 위에서 언급한 인터뷰 데이터 분석 결과 및 다양한 문헌조사 내용을 토대로 디자인 주제 및 요구사항을 다음과 같이 세 가지 로 정리하였다; (i) 응급상황에서의 즉각적 시스템 요구, (ii) 수화 교육의 체계적인 기술적 접근, 그리고 (iii) 정확한 소통을 위한 소리정보의 시각화이다. 이 단계는 청각장애인들의 니즈나 요구사항과 관련된 디자인 문제해결 가능성에 초점을 두고 인터뷰 분석 결과를 다각도로 재해석(Kim & Monk, 2012; John, 2014)한 것으로, 여러 분야 전문가들과 워크숍을 통해 의미 있는 부분으로 요약하여 정리한 것이다 (cf. Gaver et al., 1999; Dorish, 2006; Boehner et al., 2007).

첫째, 응급상황에서의 즉각적 시스템에 대한 요구는 청각장애인 스스로 위험신호에 즉각적으로 반응할 수 있는, 아주 간단하지만 신뢰성이 강한 웨어러블 형태의 디자인이 필요하다는 것이다. 이것은 ‘T3. 응급상황에서 소통의 한계’와 연관성이 강하다. 주변 상황을 소리를 통해 쉽게 인지할 수 있는 비장애인과 달리 청각장애인들은 사고에 노출될 가능성이 훨씬 높다는 것이 문제의 핵심으로 간주되었다. 관련 사례 중 베이비 크라이 시그널(baby cry signal)[s80]이나 플래시 라이트(strobe lights)를 이용한 화재 경보장치(smoke alarm signaler)[s71] 등은 위치기반의 보조 기술 장치이며, 진동과 시각정보 표현으로 관심과 주목을 받았던 바이브링 센서(Vibering sensor)[s204]는 컨셉 디자인 단계에 머물러 더 이상 발전되지 못하였다. ‘T7. 가치비용과 개인맞춤형 디바이스’와 연계되어, 청각장애인이 스스로의 주변 소리상황에 즉각적으로 반응할 수 있는 단일 목적(single purpose) 기반의 장치가 필요하다.

둘째, 수화 교육의 체계적인 기술적 접근은 청각장애인들이 수화콘텐츠를 스스로 제작하고 활용할 수 있는 방식으로 개발될 필요가 있다. 이것은 ‘T6. 문화와 언어학적 기초로서의 기술력’과 연관성이 강하며, 일상생활에서 다양한 문제 상황을 이해하고 이를 수화체계로 연계시키는 방법적 연구가 필요하다. 예를 들면, 우선 '청각장애인 추천 문학작품'에 대한 분석(Oh & Seo, 2016)에서 나타난 다양한 문제 상황 구조와 사례들을 체계적으로 접근하여 ‘서로 읽고 쓰고 인터랙션’ (Rosenblatt, 1988)할 수 있는 교육적 프로그램 개발 및 지원이 요구된다. 그리고 수화역할놀이(cf. Kilgour et al., 2015) 등 다양한 수화 구현 방법에 대한 연구도 개발된 필요가 있다. 특히, ‘T9. 스마트폰과 다양한 미디어 서비스’와 연관되어, 음성을 수화 동영상으로 변환시켜 보여주는 게임 어플리케이션(Vinluan et al., 2015)이나, 수화 동영상에 캡션을 달아주는 시스템(Ahmed, 2017), 또는 수화를 음성으로 변환시켜주는 사인얼라우드(SignAloud, O'Hare, 2016) 등의 해외 사례조사를 통해 국내에서도 청각장애인과 비장애인을 연결시켜주는 새로운 소통방식에 대한 연구가 필요하다.

셋째, 정확한 소통을 위한 소리정보의 시각화는 ‘T10. 공감각적으로 의미와 뉘앙스의 명확한 전달’과 연계된다. 여기서 핵심은 청각장애인을 위한 서비스 디자인에서 의미 있는 청각 신호를 어떻게 시각적 정보로 표현해 주느냐에 관한 것이다. 그 범위는 문제 상황과 목적에 따라 ‘그림’[s204]이나 ‘색채코드’[s192]', ‘문장기호’[s166]에서부터 ‘시각과 촉각’[s164]이나 ‘수화통역’[s151]에 이르기까지 다양하다. 따라서 청각장애인들을 위한 특정 상황에서의 유저 인터페이스 디자인이 필요할 것이다. 예를 들면, ‘그림’이나 ‘색채코드’의 활용은 메시지에 감성을 담을 수 있고, ‘문장기호’와 ‘진동’의 조합은 메시지의 뉘앙스를 더 섬세하거나 더 강하게 표현할 수 있다. 청각장애인들이 주로 사용하는 미디어를 토대로 활용 가능한 템플릿을 새롭게 구성할 필요가 있다.

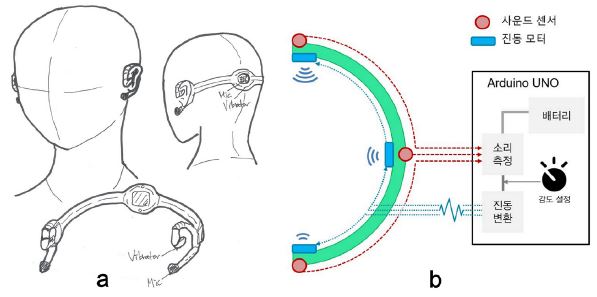

본 연구에서는 위의 세 가지 디자인 주제 중 첫 번째, ‘응급상황에서의 즉각적 시스템에 대한 요구’가 가장 중요하게 해결해야 할 문제로 간주되었다. 응급상황에서의 ‘어이없는 사고’를 줄이고 ‘위험한 상황’을 피할 수 있는 시스템 개발에 가장 큰 우선순위를 두었기 때문이다. 청각장애인들의 근본적인 문제를 ‘개인에 맞는 기구’와 ‘가격’에 초점을 두어 디자인 컨셉, 사운드얼럿(SoundAlert)을 제안한다. 사운드얼럿 (SoundAlert)은 주변 환경의 소리를 진동 형태로 변환시켜 응급상황을 즉각적으로 인지할 수 있도록 도와주는 웨어러블 디바이스이다.

4. 2. 사운드얼럿(SoundAlert)의 컨셉과 작동원리

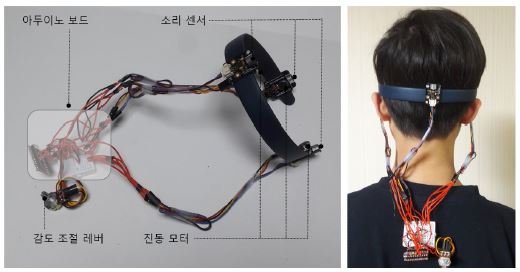

사운드얼럿(SoundAlert)은 아래 그림(Figure 7a)과 같이 머리의 양 옆과 뒤에 설치된 세 개의 사운드 센서와 진동 모터로 이루어진 헤드셋 형태의 장치이다. 이를 통해 각 위치에서 감지된 소리의 강도에 따라 진동의 세기를 달리하여 소리의 방향과 크기를 사용자에게 전달할 수 있다. 또한, 환경이 조용하거나 시끄럽더라도 진동의 감도를 조절할 수 있다. 쉽고 간편하게 착용할 수 있어 청각 장애인의 일상생활에 안전과 편리함을 동시에 만족시킬 수 있도록 디자인하였다.

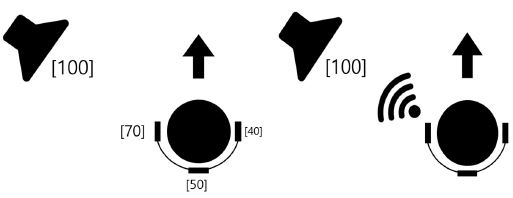

사운드얼럿(SoundAlert)의 기본적인 작동 원리는 소리의 크기를 측정하여 각각의 진동모터에 소리의 크기를 반영하도록 머리의 양 옆과 뒤에 세 개의 사운드 센서를 장착하는 것이다(Figure 7b). 소리의 근원과 거리가 가까우면 진동이 커지고 멀면 작아져 소리의 위치와 크기를 알 수 있게 된다. 또한 시끄러운 외부나 조용한 실내에서는 평상시 측정되는 값의 수준이 다르기 때문에 사용자 스스로 감도 조절이 가능하도록 조절할 필요가 있다.

청각장애인 사용자에게 단순히 진동만을 통해 소리의 크기와 위치를 전달하는 것은 결코 쉬운 일이 아니다. 따라서 진동을 통한 소리의 위치 및 크기 인식은 비장애인이 귀로 소리를 인식하는 방법을 최대한 활용할 필요가 있다. 예를 들면, 왼쪽에서 100의 소리가 났을 때 왼쪽 귀는 80, 오른쪽 귀는 60의 소리를 인식한다. 이것은 왼쪽 귀가 오른쪽 보다 더 큰 소리를 인식했기 때문에 소리가 왼쪽에서 났다는 것을 알려주는 것이다 (Figure 8).

사운드얼럿(SoundAlert)의 첫 번째 소리의 크기와 방향에 대한 작동 원리는 위의 방법을 그대로 적용한 것이다(Figure 8). 예를 들면, 왼쪽 앞에서 100의 소리가 났을 때, 왼쪽 센서는 70, 뒤쪽은 50, 오른쪽은 40의 소리를 인식하여 각각 값에 맞는 진동을 준다. 그러면 사용자는 왼쪽과 뒤쪽에서 진동의 강도를 인식하고 왼쪽에서 소리가 나는 것을 알 수 있게 된다.

사운드얼럿(SoundAlert)의 두 번째 작동 원리는 감도 조절 시스템과 진동 주기 변형 알고리즘에 대한 것이다. 우선, 시끄러운 공사장이나 공공장소에 있을 때는 잡음을 줄이기 위한 감도 조절 기능은 포텐셔미터 (potentiometer)를 돌려 필요에 따라 간단히 일정 볼륨 이하의 소리를 완전히 차단할 수 있도록 한다. 또 다른 기능은 진동 주기 변형 알고리즘이다. 사람의 귀는 박수와 같은 짧고 순간적인 소리도 정확히 인식할 수 있지만, 순간적인 진동은 사람이 파악하기 어렵다. 따라서 사용자가 진동 주기를 인지할 수 있을 정도로 진동의 간격을 늘려주는 알고리즘을 만들어 프로그램에 추가한다.

4. 3. 사운드얼럿(SoundAlert) 프로토타입 제작

사운드얼럿(SoundAlert)은 진동모터 세 개와 사운드 센서 세 개가 헤어밴드의 왼쪽, 오른쪽, 그리고 뒤쪽에 각각 쌍으로 부착되고, 포텐셔미터로 소리의 감도를 조절하는 워킹 프로토타입이다 (Figure 9). 사운드 센서는 헤어밴드 바깥쪽에, 진동 센서는 헤어밴드 안쪽에 부착되어, 사용자가 헤어밴드를 쓰고 있는 상태에 머리에서 바로 진동을 느낄 수 있도록 하였다. 부품과 프로그램은 아두이노를 이용하였다.

청각장애인들이 사운드얼럿(SoundAlert)을 실제 제품으로 활용하기 위해서는 프로토타입에서 사용한 아두이노 부품들보다 훨씬 더 컴팩트하고 효율이 좋은 부품으로 크기와 무제를 최소화할 필요가 있다. 또한, 소리의 크기 뿐 아니라 높낮이까지 감지할 수 있는 정밀한 사운드센서를 적용하면 진동의 주파수를 달리하여 더 명확한 위치를 인지하는데 도움을 줄 수도 있을 것이다.

5. 결론 및 향후 연구

5. 1. 연구의 기대효과

본 연구는 수화통역사의 도움으로 청각장애인과 직접 심층 인터뷰를 진행하면서 그들의 일상생활과 소통하는 방식을 그들의 관점에서 이해하고자 진행된 질적 연구이다. 또한, 그 결과를 재해석하여 디자인 주제에 대한 문제점과 요구사항들을 파악하고, 그 중 한 부분으로써, 사운드얼럿(SoundAlert) 프로토타입을 개발하였다. 인터뷰 데이터 분석은 근거이론분석(Strauss & Corbin, 1998; Chamaz, 2006) 중 오픈 코딩(open coding)과 선택 코딩(selective coding) 방법을 이용하였다. 그 결과 청각장애인들의 삶과 소통에 대한 12개의 주제를 네 가지 핵심 범주 로 나타내는 도식적 관점(Figure 4, Schematic view, Strauss & Corbin, 1998)을 구성하였다. 핵심 범주는 (a) 소통의 어려움과 한계, (b) 언어학적 교육환경, (c) 다양한 기술과 서비스, 그리고 (d) 새로운 가능성과 희망이다. 각각의 범주는 ‘T1. 소리가 없는 사람들의 삶과 문화’, ‘T2.표현의 불명확성과 정보습득의 어려움' 등의 주제를 포함하여 연관된 코드 및 인터뷰 사례들과 함께 묘사되었다. 이 결과는 청각장애인들의 관점에서 바라보는 삶과 소통의 현실적인 문제점을 더욱 깊게 이해할 수 있는 도구가 될 것이다.

본 연구에서는 이러한 체계적 데이터 분석 결과를 디자인 연구를 위한 세 가지 주제 및 요구사항으로 재해석하였다; (i) 응급상황에서의 즉각적 시스템 요구, (ii) 수화교육의 체계적이고 다양한 기술적 접근, (iii) 정확한 소통을 위한 소리정보의 시각화이다. 그리고 첫 번째 주제에 따라 세 개의 사운드 센서와 진동 모터로 소리의 방향과 크기를 전달하는 헤드셋 형태의 웨어러블 디바이스, 사운드얼럿(SoundAlert) 프로토타입을 제작하였다. 향후 연구는 사운드얼럿(SoundAlert)을 여러 그룹의 청각장애인들에게 실제로 사용해 보도록 하여 얼마나 효과적으로 위험상황을 인지할 수 있는지에 대한 구체적인 현장 조사가 필요할 것이다. 또한, 스마트폰 애플리케이션과 연계하여 IoT를 활용할 수 있는 가능성도 검토할 것이다.

한편, 디자인 주제에 대한 ‘수화교육의 기술적 접근’ 및 ‘소리정보의 시각화’ 부분은 다른 프로젝트의 향후 연구로 발전시켜 심도 있게 진행할 계획이다. 심층 인터뷰 방법에 있어서 기존 서비스 사례에 대한 참여자들의 반응은 긍정적으로, 자연스럽고 솔직하게 그들의 생각과 느낌을 표현하는데 어려움이 없었다. 특히, 개인의 취향과 문제점을 섬세하게 충족시켜줄 수 있는 구체적인 디자인을 요구하고 있었다. 이 부분의 인터뷰 분석 결과 및 재해석 결과는 청각장애인들과 직접 공유하며 함께 발전시키는 ‘코-크리에이터 (co-creator)' (Mortensen, 2018) 역할을 할 수 있을 것으로 기대된다.

최근 다양한 스마트기기의 발전으로 일상생활이 편리해지고 있지만, 청각장애인들이 필요로 하는 휴대용 기기나 시설 및 제도적인 측면은 여전히 부족하다. 사운드얼럿(SoundAlert)은 청각장애인의 일상생활을 돕고 위험상황을 인지하여 사고율을 낮추고 안전하고 편리한 생활에 도움을 주도록 디자인되었다. 이러한 기술들이 계속 발전되어 청각장애인들도 안전함과 동시에 삶의 질을 높이는데 기여할 수 있을 것으로 기대된다.

5. 2. 연구의 한계

본 연구의 인터뷰 대상자는 네 명이었으며, 그 중 청각장애인 세 명은 사회적 기업에 종사하는 20대 여성으로 수화통역사와 함께 인터뷰를 진행하였다. 따라서 수화를 말로 통역하는 과정에서 정확한 의미 전달에 오류가 있을 수 있다. 또한 수집된 텍스트 데이터의 분량이 충분히 많지 않아 최종적으로 나타난 분석 결과에 대한 신뢰도에 있어서도 어느 정도 한계점을 지닌다. 향후 연구에서는 추가 인터뷰를 진행하여 분석 결과에 대한 구체적인 검증이 필요할 것이다.

Glossary

Acknowledgments

This work was supported by the BK21 plus project of the National Research Foundation of Korea Grant.

무엇보다도 인터뷰에 참여해주신 청각장애인분들과 연구에 관심과 격려를 아끼지 않으셨던 BK21플러스 교수님들께 깊은 감사의 말씀을 전합니다. 사운드얼럿(SoundAlert) 아두이노 프로토타입은 류한비 학생(수원 정천중학교)이 제작하였습니다.

Notes

Copyright : This is an Open Access article distributed under the terms of the Creative Commons Attribution Non-Commercial License (http://creativecommons.org/licenses/by-nc/3.0/), which permits unrestricted educational and non-commercial use, provided the original work is properly cited.

References

- Ahmed, T. S. (2017). Real Time American Sign Language Video Captioning using Deep Neural Networks. GPT Technology Conference.

- Anderson, K. (2009). Ethnographic Research: A Key to Strategy. Harvard Business Review 87(3), 24.

-

Boehner, K., Vertesi, J., Sengers, P., & Dourish, P. (2007, April). How HCI Interprets the Probes. In Proceedings of the SIGCHI Conference on Human Factors in Computing Systems (pp. 1077-1086). ACM.

[https://doi.org/10.1145/1240624.1240789]

- Borland, R. H. (2011). 'Radical Plumbers and PlayPumps - Objects in development' (Unpublished doctoral dissertation). Electronic and Electrical Engineering, MIT Press.

- Chambers, A. (2009, November 24). Africa's not-so-magic roundabout. The Guardian. Retrieved October 2, 2016, from https://www.theguardian.com/commentisfree/2009/nov/24/africa-charity-water-pumps-roundabouts.

- Charmaz, K. (2006). Constructing grounded theory: A practical guide through qualitative analysis. London: Sage.

- Choi, S., & Seo, C. (2002). 디지털 음성변환이 청각장애아동의 어음변별력 향상에 미치는 효과 [The Effectiveness on Speech Discrimination Ability for the Hearing Impaired with Digital Speech Transformation]. The Journal of Special Education: Theory&Practice, 3(1), 41-57.

- Dourish, P. (2006, April). Implications for Design. In Proceedings of the SIGCHI Conference on Human Factors in Computing Systems (pp. 541-550). ACM.

-

Gaver, W., Dunne, T., & Pacenti, E. (1999). Cultural Probes, Interactions, 6(1), 21-29.

[https://doi.org/10.1145/291224.291235]

- Gretton, C. & Honeyman, M. (2016, January 01). The digital revolution: eight technologies that will change health and care. The King's Fund: Ideas that change health care. Retrieved January 9, 2016, from https://www.kingsfund.org.uk/publications/eight-technologies-will-change-health-and-care.

- Heckendorf, S. (2009). Assistive technology for Students who are Deaf or Hard of Hearing in Assessing Students' Needs for Assistive Technology. WATI: Wisconsin Assistive Technology Initiative. Retrieved January 9, 2016, from http://www.wati.org/wp-content/uploads/2017/10/Ch13-Hearing.pdf.

- James, A. (2008). Stereo Listening Rings - Two Rings to Rule Them All. Yangko Design. Retrieved October 8, 2014, from http://www.yankodesign.com/2008/06/03/stereo-listening-rings-two-rings-to-rule-them-all/.

- John, W. C. (2014). Research Design: Qualitative, Quantitative, and Mixed Methods Approaches. London: SAGE.

- Jung, H., & Han, K. (2008). 청각 장애인을 위한 UCC 기반 수화교육 웹 콘텐츠 설계방안에 대한 연구 [A Study on Strategy for Developing UCC-based Sign Language education Web-content for the Hearing Impaired]. Korean Society of Design Trend, 19, 213-222.

- Kaye, H. S. (2000). Computer and Internet use among people with disabilities. Disability Statistics Report (13). Washington, DC: U.S. Department of Education, National Institute on Disability and Rehabilitation Research.

- Kilgour, W. P., Reynaud, D., Northcote. T. M., & Shields, M. (2015). Role-Playing as a Tool to Facilitate Leaning, Self Reflection and Social Awareness in Teacher Education. International Journal of Innovative Interdisciplinary Research, 2(I4), 3-20.

- Kim, B., Kang, C., & Choi, Y., (1994). 청각장애와 언어 [Hearing impairment and language]. Daegu University Press.

- Kim, D., Lee, G., & Kim, H. (2017). 음성인식 AI 비서 시장의 현황과 시사점 [Analysis of speech recognition technology and personal assistant service using AI]. The Korean Institute of Communications and Information Sciences, 29(9), 213-214.

- Kim, H., & Monk, A. (2012). Review of methods for eliciting qualitative data in a design setting: Interpretation of the use of Cultural probes. In Proceeding of Spring International Conference (pp. 18-19). Incheon, KSDS.

- Kim, H. (2016). Understanding Communication of the Deaf and Hard of Hearing. In Proceeding of Spring International Conference (pp. 94-95). Seoul, KSDS.

- Kim, H. (1993). 청각장애아동의 어음변별력에 관한 연구 [Study on Speech Discriminations of Children who are Deaf and Hard of Hearing]. (Unpublished master's thesis). Daegu Univesity, Daegu, Korea.

-

Kim, H., Monk, A., Wood, G., Blythe, M., Wallace, J., and Olivier, P. (2013). TimelyPresent: connecting families across continents. International Journal of Human Studies, 71(10), 1003-1011.

[https://doi.org/10.1016/j.ijhcs.2013.05.001]

- Kim, J. (2011). 원격 교육지원이 청각장애대학생의 강의참여에 미치는 효과 [The Effects of Distance Supports of Education on Lesson Participation of University Students with Hearing Impairments]. The Journal of Special Education: Theory and Practice, 12(1), 435-458.

-

Kvale, S. (2006). Qualitative Inquiry: Dominance Through Interviews and Dialogues. Qualitative inquiry, 12(3), 480-500.

[https://doi.org/10.1177/1077800406286235]

- Lee, C. (2015). 장애 극복을 돕는 부드럽고 따뜻한 소프트웨어 [Transcence: Soft and warm software for the help of overcoming the disability]. Huffington Post. Retrieved October 2, 2016, from http://www.huffingtonpost.kr/2015/03/10/story_n_6836870.html.

- Lee, D. (2009). 디지털 음성처리 방식을 이용한 단일채널 인공와우의 임상성능 개선에 관한 연구 [Study on the clinical performance improvement of the single-channel cochlear implant using digital sound processing algorithm]. (Unpublished doctoral thesis). Seoul University, Seoul, Korea.

- Lee, H., & Choi, S. (2015). 이중언어 농학생의 동반입학 지원을 위한 창조적 소수의 도전 [The challenges of the creative minority towards supporting co-enrollment of sign-bilingual Deaf students]. Korean Association Of The Children With Special Need, 17(2), 285-313.

- Lee, J. (2015). 청각장애인 소통 돕는 스마트안경 '쉐어타이핑 글래스' [Smartglass, 'Sharetyping' helps the communication for the deaf]. Retrieved October 2, 2016, from https://www.bloter.net/archives/236571.

- Lee, W. (2017). 한국수화언어법 제정의 의의와 실제 [Meaning and reality of the enactment of the law of Korean Sign Language]. Ministry of Culture, Sports and Tourism Korean Language Policy. Special edition: Special language policy, 33-48.

-

Maisrana-Basas, M., & Pagliaro, C. (2014). Technology Use Among Adults Who Are Deaf and Hard of Hearing: A National Survey. Journal of Deaf Studies and Deaf Education, 19(3), 400-410.

[https://doi.org/10.1093/deafed/enu005]

- Monk, A., & Gilbert, N. (1995). Perspectives on HCI: Diverse Approaches. London: Academic Press Limited.

- Mortensen, D. (2018). Best Practices for Qualitative User Research. Interaction Design Foundation. Retrieved January 9, 2018, from https://www.interaction-design.org/literature/article/best-practices-for-qualitative-user-research.

- Oh, S., & Seo, C. (2016). 청각장애 관련 문학작품에 나타난 의사소통 문제상황 분석: 의사소통방법 정교화의 필요성 [Analysis of Communication Problem Situation in Literature related to Hearing Impairment: the Necessity of Communication Mode in Accuracy]. Journal of Special Education: Theory and Practice, 17(3), 1-34.

- O'Hare, R. (2016). 'SignAloud' gloves translate sign language gestures into spoken English, Mailonline. Daily Mail. Retrieved October 2, 2016, from http://www.dailymail.co.uk/sciencetech/article-3557362/SignAloud-gloves-translate-sign-language-movements-spoken-English.html.

- Park, J. (2011). 정보화 수준이 청각장애(농)인의 역량강화에 미치는 영향에 관한 연구 [A Study on the influences of information level on empowerment of people with hearing impairment] (Unpublished master's thesis). Gangnam University, Yongin, Korea.

- Rosenblatt, L. M. (1988). Center for the study of reading: a reading research and education center report. Writing and Reading: The Transactional Theory. Technical Report No. 416, New York University.

-

Schilit, B. N., Hilbert, D. M., & Trevor, J. (2002). Context-Aware Communication. IEEE Wireless Communication, 9(5), 46-54.

[https://doi.org/10.1109/MWC.2002.1043853]

- Seo, D. (2007). 충남 아산(온양) 지역 수화의 어휘 특성에 관한 조사 연구:「한국수화사전」을 중심으로 한 비교 분석 [An Investigative Study on the Lexical Characteristics of the Regional Sign Language in Asan(Onyang)]: Chungcheongnam-do : A Comparative Analysis with focus on「Korean Sign Language Dictionary」] (Unpublished master's thesis). Korea Nazarene University, Cheonan, Korea.

-

Sparrow R., (2005). Defending Deaf Culture: The Case of Cochlear Implants. The Journal of Political Philosophy, 13(2), 135-152.

[https://doi.org/10.1111/j.1467-9760.2005.00217.x]

- Strauss, A., & Corbin, J. (1998) Basics of Qualitative Research: Techniques and Procedures for Developing Grounded Theory. London: SAGE Publications.

- Tran, L. (2009). Feel The Music. Yangko Design. Retrieved January 9, 2016, from http://www.yankodesign.com/2009/11/17/feel-the-music/.

- Vilnluan, A., Gabriel, J., & Cabantog, J. (2015). BTCOM: A Mobile Applications on Sign Language Processing for Communication to Deaf-Mute and Hearing Impaired. New Era University Conference papers, Philippines (pp.1-6).

- Whang, J. (2009). 정보격차 해소를 위한 장애인 정보화 교육의 실태와 문제점 연구 [Resolution for the Digital Divide: Current Status and the Problem Analysis of Information Technology Education for the Disabled] (Unpublished master's thesis). Konkuk University, Seoul, Korea.

- Yoon, S. (2017). 한국수어(KSL) 연구의 필요성과 전망 [The nessities and Prospects for Studying on Korean Sign Language]. The Society of Korean linguistics, 83, 93-118.

- Young, I. (2008). Mental Models: Aligning Design Strategy with Human Behavior. New York: Rosenfeld.

- 보건복지부 [The Minister of Health and Welfare]. (2014). 장애인실태조사 [Study the real condition of the disabled].

- 한국인터넷진흥원 [Korea Internet & Security Agency] (2016). 인터넷이용실태조사 [Study the real condition of the use of Internet].